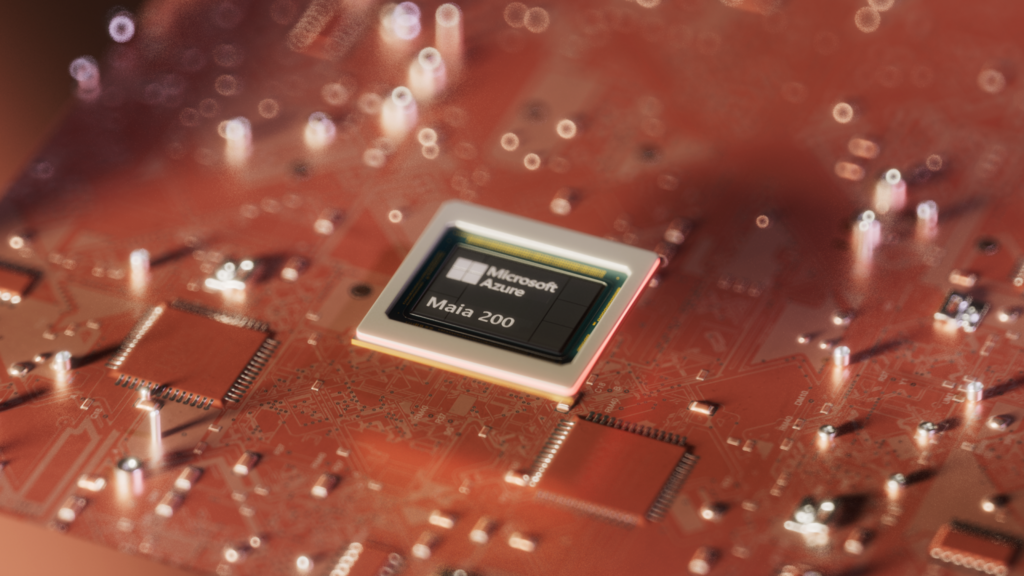

מיקרוסופט מצמצמת את התלות באנבידיה: משיקה שבב AI משלה

ענקית הטכנולוגיה הכריזה על Maia 200, מאיץ בינה מלאכותית שפותח באופן עצמאי ומיועד להרצת מודלי AI בדאטה סנטרים של Azure. בשלב ראשון ישמש המאיץ את צוותי הבינה המלאכותית של מיקרוסופט, ובהמשך גם לקוחות Azure

מיקרוסופט הכריזה על השקת Maia 200, שבב מאיץ בינה מלאכותית חדש שפיתחה באופן עצמאי ומיועד להרצת מודלי AI בזמן אמת בדאטה סנטרים של Azure. מדובר במהלך אסטרטגי שמצטרף למגמה רחבה בתעשיית הענן, שבה ספקיות הענן הגדולות משקיעות בפיתוח מאיצי AI ייעודיים משלהן. זאת, במטרה לשפר ביצועים, להפחית עלויות ולהבטיח שליטה הדוקה יותר בתשתיות הבינה המלאכותית, שהפכו לנכס אסטרטגי בליבת המודלים העסקיים של החברות.

מאיץ בינה מלאכותית הוא רכיב חומרה ייעודי שתוכנן במיוחד לביצוע החישובים שעליהם נשענים מודלי AI, ובראשם חישובי מטריצות והזזת כמויות גדולות של נתונים בין זיכרון לליבות החישוב. מרבית השימושים המסחריים בבינה מלאכותית, בהם צ’אטבוטים, מנועי חיפוש וכלי פרודוקטיביות, מבוססים על הרצת מודלים שכבר אומנו, ולא על אימון שלהם, ולכן מאיצי הרצה ייעודיים הפכו לרכיב קריטי בתשתיות הענן של חברות הטכנולוגיה הגדולות.

בשנים האחרונות מפתחות גם מתחרותיה של מיקרוסופט בענן מאיצי בינה מלאכותית ייעודיים משלהן, כחלק ממאמץ לצמצם תלות במעבדים גרפיים של אנבידיה ולשלוט טוב יותר בעלויות ובביצועים. גוגל מפעילה מזה כעשור את סדרת שבבי TPU, המשמשים לאימון ולהרצה של מודלי AI בתשתיות גוגל קלאוד. אמזון פיתחה את Inferentia להרצת מודלים ואת Trainium לאימון ולהרצה בענן AWS.

המשתמשים הראשונים ב-Maia 200 יהיו צוותי הבינה המלאכותית של מיקרוסופט, שישתמשו בו ליצירת נתונים ולפיתוח הדור הבא של מודלי ה-AI של החברה. בהמשך ישולב המאיץ גם בהפעלת שירותים כמו 365 Copilot ופלטפורמת Foundry, ובהדרגה צפויה מיקרוסופט לפתוח את השימוש בו גם ללקוחות Azure.