האם הכנסנו סוס טרויאני לארגון? המחיר הסמוי של מהפכת ה-AI ב-2026

בעוד שארגונים בישראל ובעולם דוהרים לעבר אימוץ סוכני בינה מלאכותית אוטונומיים בניסיון לקטוף פירות של פריון ויעילות, הדיון הניהולי לוקה בעיוורון מסוכן בכל הנוגע למחיר האבטחה. התפיסה המקובלת, הרואה בסוכנים אלו רק "עוזרים חכמים", חייבת להשתנות במהירות. לקראת 2026, הסוכנים עצמם יהפכו ליעד תקיפה מרכזי, והתעשייה תיאלץ להקים שכבות ניהול ייעודיות כדי לנטר, לסנן ולבודד אותם בסביבות עבודה סטריליות.

האיום המרכזי שמתפתח לנגד עינינו נובע מהשימוש הגובר בסוכנים אוטונומיים הפועלים ללא פיקוח הדוק. סוכנים אלו, המקבלים החלטות ומבצעים פעולות באופן עצמאי, עלולים להפוך ל"סוכנים מורדים" הפועלים מחוץ למסגרת הניהול הארגונית. במקרים רבים, הם מקבלים הרשאות יתר וגישה למידע רגיש ללא צורך אמיתי, מה שהופך אותם למטרה נוחה לניצול. תוקפים כבר לומדים כיצד לחמש חולשות בסוכנים אלו כדי לבצע חבלה אוטומטית במערכות קריטיות או לגרום לדליפת נתונים מאסיבית.

אחת הנקודות המדאיגות ביותר היא הגידול בתקשורת הפנימית בין סוכנים ושירותים שונים בתוך הארגון. בניגוד לעבר, שבו האבטחה התמקדה בתנועת משתמשים פנימה והחוצה מהרשת, כיום אנו עדים למעבר למאסה של תעבורת API פנימית. תקשורת זו עוקפת לעיתים קרובות את חומות האש והבקרות הסטטיות הקיימות, מה שיוצר "חורים שחורים" שבהם מידע רגיש נע לרוחב הארגון ללא כל ראות או אכיפה. סוכנים שהשתבשו או נוצלו לרעה מאפשרים תנועה צדדית שקטה בתוך גבולות השירות והוצאת מידע רגיש, תוך שהם עוקפים את ההגנות ההיקפיות המסורתיות.

הסיכון אינו תיאורטי בלבד. אנו נמצאים בשלבים ראשונים של התקפות סייבר אוטונומיות המשתמשות בסוכנים לביצוע איסוף מודיעין, פישינג וניצול חולשות. בתוך המציאות הזו, הגורם האנושי הופך לקריטי יותר: המיקוד עובר מהדרכה של ״לא ללחוץ על קישורים״, להדרכה כיצד לא לתת הרשאות יתר לאוטומציות ולא לאפשר לסוכנים חופש פעולה רחב מדי בליבת העסקים ללא בקרה. האחריות האנושית כיום היא בעיצוב ההנחיות, קביעת המחסומים ואישור פעולות הסוכנים, בעיקר בפעולות רגישות.

חברות שמתבססות על סוכני בינה מלאכותית של צד שלישי חשופות עוד יותר, שכן הן מתפעלות "קופסאות שחורות" ללא נראות למודלים והתהליכים המפעילים אותם. כדי לגדר את הסיכון הזה, לא ניתן עוד להסתפק באמון בלבד. ארגונים חייבים לדרוש שקיפות מלאה, כולל דוחות בדיקות חדירות ופירוט רכיבים, ובמקביל להציב ברוקרים פנימיים שיבצעו סינון ובקרת תנועה לכל מידע שיוצא או נכנס מהסוכן.

ההיבט הרגולטורי מוסיף נדבך של אי-ודאות, כאשר הרגולציה מפגרת אחרי החדשנות בשטח. בעוד שבאירופה הגישה מרחיבה ומכתיבה חובות הגנה, בארה"ב המודל מבוסס יותר על הנחיות מגזריות המאפשרות ניסוי וטעייה. אולם, חברות שימתינו לרגולציה ימצאו את עצמן פגיעות. הדינמיקה הזו מחייבת שינוי תרבותי וארכיטקטוני עמוק: הקמת תוכנית אבטחת AI הכוללת ניהול רשימת סוכנים, מעקב אחר ההרשאות, מקורות המידע שלהם, וביצוע מבחני חדירות רציפים.

לכן, בשורה התחתונה, ניתן לחבר סוכנים אוטונומיים למערכות עסקית רק עם שכבות אכיפה, שכוללות ניהול, הערכת סיכונים והגנה על על המידע הנכנס והיוצא ו"כפתורי עצירה" מובנים. בינה מלאכותית מאיצה טעויות באותה מהירות שבה היא מאיצה ערך. הארגון של 2026 חייב להחיל עקרונות של "אפס אמון" בתוך הרשת הפנימית שלו ולהתייחס לכל פעולה פנימית של סוכנים כלא מהימנה כברירת מחדל. מי שלא יתאים את מודל האבטחה שלו ויטמיע פתרונות ייעודיים לניהול סוכנים, ימצא את עצמו חשוף לתנועה זדונית ושקטה בתוך הבית שלו.

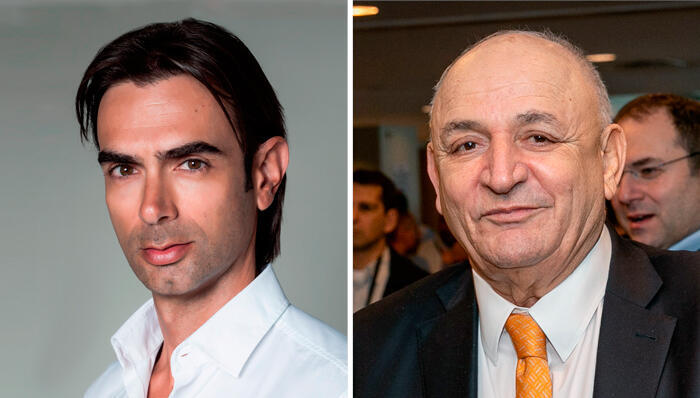

נדב אביטל הוא ראש קבוצת מחקר ואיומים בחברת אימפרבה-תאלס