האם בינה מלאכותית יכולה לצמצם את הפער המגדרי בהייטק?

הפערים לא נעלמים, רק משנים צורה – אולי דווקא AI יוכל לשבור את תקרת הזכוכית

לאחרונה, קולגה שלי, מנהל מוצר בכיר ומוערך –פנה אליי ושאל בתום לב: "למה בכלל צריך לפעול לקידום שוויון מגדרי? הרי אין חוקים שמפלים נשים – הדלת פתוחה בפני כולן. מי שרוצה, תיכנס." זו אינה שאלה יוצאת דופן, ובמובנים מסוימים היא אף משקפת את תחושת הרווחה שבמבט ראשון שנדמה שמאפיינת את תעשיית ההייטק. אלא שמאחורי השאלה הפשוטה הזו מסתתרים מנגנונים מורכבים של חסמים, פערי גישה, הטיות בלתי מודעות ותקרות זכוכית שקופות – שממשיכות לשמר פערים גם בעידן של שוויון פורמלי.

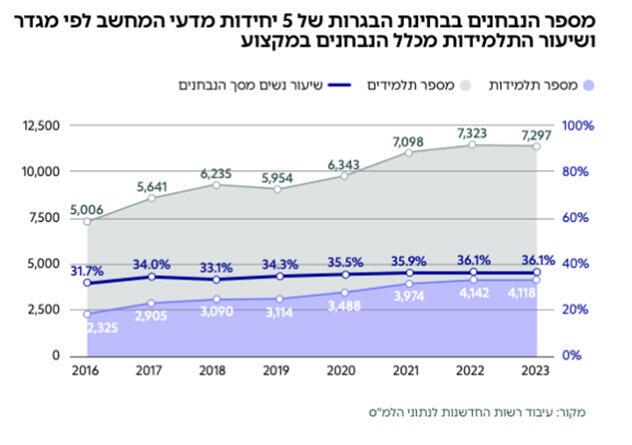

על פי דו״ח של רשות החדשנות 2025, (רשות החדשנות - דו”ח תמונת מצב נשים בהייטק 2025 ) למרות עלייה מתמשכת במספר הנשים בתעשיית ההייטק הישראלית, ייצוגן היחסי נותר כמעט ללא שינוי: נשים מהוות רק כשליש מכוח העבודה בענף, ורק כרבע מעובדי הפיתוח. בתחומי הניהול הבכיר, האחוזים נמוכים עוד יותר (10.6%). עובדות מעניינות נוספת הן שהחל מ-2016 חלה עליה משמעותית במספר הנבחנות בבחינה של 5 יחידות לימוד במדעי המחשב (77%+) ובנוסף מספר הסטודנטיות הלומדות את מקצועות ההייטק במוסדות ההשכלה הגבוהה הוכפל בעשור האחרון ועל אף העלייה המשמעותית, חלקן היחסי של נשים בענף ההייטק עומד על 36.1% בלבד. נדמה שמדובר בנתונים שאינם תוצאה של העדפה אישית בלבד, אלא של חסמים מבניים ומערכתיים שנמשכים כבר למעלה משלושה עשורים.

למרות פעילותן המבורכת של עמותות רבות בישראל לקידום נערות ונשים צעירות לעולם הטכנולוגיה – בהן QueenB, שמפעילה חוגי קוד עבור מאות נערות חטיבת ביניים; CyberGirlz, המכשירה אלפי בנות בתחומי סייבר ומשלבת אותן ביחידות טכנולוגיות; ועוד רבות אחרות הפועלות לשבירת סטריאוטיפים והרחבת ההזדמנויות – פריצת הדרך המיוחלת עדיין אינה כאן. הסיבה לכך נעוצה בקיומם של ארבעה חסמים עמוקים ומשמעותיים:

מודעות – רבות מהנערות כלל אינן מכירות את המגוון הרחב של תחומי העיסוק והתפקידים בהייטק, ומכיוון שהתחום נתפס כעולם של "תכנות בלבד", הן אינן מדמיינות עצמן משתלבות בו;

שפה מקצועית מרתיעה, שמרחיקה מי שאינה מכירה את הז'רגון;

דימוי עצמי נמוך, שמעכב צעדים ראשונים; ו־חוסר נגישות למשאבים וכלים שיכולים לאפשר להן להתנסות, ללמוד ולבחון את התאמתן. כל עוד חסמים אלה נמשכים – השוויון הפורמלי אינו מספיק כדי לגשר על הפער הממשי.

בינה מלאכותית: אתגר – והזדמנות

הבשורה הגדולה של השנה האחרונה היא הזמינות הרחבה של מודלים מבוססי בינה מלאכותית, דוגמת ChatGPT. כלים אלו מאפשרים גישה שווה ללמידה עצמית, לתרגול שפה מקצועית, לסימולציות ראיונות ולחיפוש אחר תפקידים מותאמים אישית – ללא צורך בתיווך אנושי יקר, רקע קודם או מגבלות גיאוגרפיות.

יתרונם המרכזי של אותם כלים הוא בניטרול גורמים מפלים: הם אינם בוחנים את הרקע החברתי, המגדר או המבטא של המשתמשת, אלא מתמקדים בשאלות ובתשובות בלבד. עבור נערות רבות – במיוחד בפריפריה – מדובר בפריצת דרך משמעותית.

מנגנון מועיל או משמר פערים?

עם זאת, חשוב להכיר גם את הסכנות הטמונות ביישום בלתי מבוקר של מערכות בינה מלאכותית. דוגמאות מתועדות, ממחישות כיצד אלגוריתמים עשויים לשעתק ולחזק הטיות קיימות (Algorithm Bias)

1. Amazon גרסה 2015 – כלי גיוס מפלה נשים

בשנת 2015 אמזון השביתה מערכת AI שפותחה למיון מועמדים לעבודה לאחר שגילו שהיא מפלה נשים. הכלי פסל מועמדות שסיימו מכללות לנשים בלבד, ואף דירג נמוך קורות חיים שהופיעה בהן המילה "נשים". מקרה דומה התרחש בשנת 2019 בשירות הסטרימינג Spotify, כשנמצא שמערכת ההמלצות שלו הציעה בעיקר אמנים גברים – והפלתה לרעה יוצרות מוזיקה. Wikipedia.

2. LLMs שמפלים נשים

מחקר מקיף מ 2025 ("Who Gets the Callback?") בדק כמה מודלים של בינה מלאכותית (LLMs) בפילוח מועמדות שוויונית – וגילה שהמערכות מאזנות פחות להזדמנויות נשים, במיוחד בתפקידים עם שכר גבוה, ומשמרות סטריאוטיפים מגדריים בתמלול טקסטים של מודלי משרות arXiv.

3. Mom Penalty בבינה מלאכותית

ב 2023 נמצא שמועמדות עם הפסקות קריירה הקשורות ללידה ("maternity gaps") מסוננות לרוב החוצה על ידי מערכות סינון אוטומטיות, גם כאשר הן עומדות בקריטריונים המקצועיים הטהורים. המחקר ממחיש את סכנת ההפליה של נשים על סמך חסרים ביוגרפיים, לא על סמך כשירות engineering.nyu.edutheaustralian.com.au.

בינה מלאכותית שוויונית לא נבנית מעצמה

כדי שבינה מלאכותית תהפוך לכלי שמצמצם פערים – ולא למנגנון שמשמר אותם – נדרשת חשיבה זהירה וביקורתית על הדרך שבה היא מתפתחת. זה מתחיל בבחירת הדאטה עליו מאומנים המודלים: אם נמשיך להזין מערכות בלמידת מכונה עם נתונים מוטים – נקבל תוצאות מוטות.

מכאן גם הצורך להטמיע מדדי הוגנות ברורים (Fairness KPIs), לבדוק באופן שוטף תרחישים של אפליה (כמו קורות חיים זהים עם שמות שונים), ולוודא שמעורבים בתהליך אנשי צוות מגוונים – כולל נשים, אנשי חינוך ואתיקה. חשוב גם לא לאפשר למודל "לשקף לנו את עצמנו", אלא ליצור מנגנוני פרסונליזציה שמרחיבים חשיפה ולא מקבעים תבניות קיימות. לצד כל אלה, רגולציה מחייבת היא צעד הכרחי – במיוחד כשמדובר בטכנולוגיה שמשפיעה על קריירות, הזדמנויות וחיים שלמים.

ומה עושים עד שזה יקרה? האחריות של כולנו

עד שיבשילו שינויים מערכתיים רחבי היקף, לכל אחת ואחד מאיתנו יש תפקיד קריטי ביצירת תודעה חדשה. בכל אינטראקציה עם נערה – בין אם בכיתה, בבית, במפגש קהילתי או בשיחה מזדמנת – קיימת הזדמנות להזכיר לה כי הדלת לעולם ההייטק (ולכל תחום שמסקרן אותה) פתוחה בפניה, ושאין לה סיבה לחשוש מהעשייה הטכנולוגית.

מתוך מטרה להנגיש את האפשרויות הללו ולהתמודד עם החסמים המרכזיים שתיארתי קודם לכן, פיתחתי את HerTechFuture. זהו GPT ייעודי המשמש כמנטורית דיגיטלית לנערות ונשים צעירות בתחילת דרכן. המערכת מסייעת בזיהוי חוזקות, בהנגשת שפה מקצועית, בהיכרות עם שלל תפקידים טכנולוגיים ובהכוונה למסלולים רלוונטיים – וכל זאת באופן לא שיפוטי, מותאם אישית ובגובה העיניים.

המטרה אינה להחליף תהליך אנושי, אלא לאפשר נקודת התחלה נגישה ומחזקת – כלי שמסייע לכל אחת לדמיין לעצמה עתיד טכנולוגי אפשרי, במרחב שבו לעיתים לא ראתה קודם את מקומה.

: 🔗 HerTechFuture

סיכום

הפערים המגדריים בהייטק לא נולדו מאפליה רשמית – אלא ממערכות עמוקות של חסמים, חוסר מודעות והטיות לא מודעות. בעידן שבו בינה מלאכותית הופכת לכלי מרכזי בכל תחום, יש לנו הזדמנות נדירה להפוך אותה ממראה של העבר – למנוף לעתיד שוויוני יותר. אבל זה לא יקרה מעצמו. כדי שזה יצליח, נדרש תכנון אחראי, בקרה אתית, גיוון בפיתוח והנגשה אמיתית של הכלים – בעיקר לצעירות שעדיין לא רואות את עצמן בתוך המערכת. שינוי עמוק מתחיל כשהאפשרות נראית ממשית, והיום היא נראית יותר ממשית מאי פעם.

מאת רחלי ארליך, מנהלת מוצר ופעילה לקידום נערות בטכנולוגיה, אימפרבה

d&b – לדעת להחליט