דיפ פייק? מה שצריך להפחיד אתכם בבחירות הקרובות זה פייק טקסט

טקסט מתוחכם שיוצרת בינה מלאכותית היא בעיה מורכבת המאפשרת לנצל את יכולות אלו על מנת להשפיע על קהל אנשים רחב בדרכים עדינות הרבה יותר תוך יצירת אשלייה שמדובר בעמדת הרוב

בהתחלה, לא היתה סיבה להתרגש. לפני שנה וקצת, באביב 2019, הודיעה OpenAI, מעבדת מחקר בתחום הבינה המלאכותית שבין מייסדיה נמנה אילון מאסק, שיצרה אלגוריתם שמסוגל לחולל טקסט, כמו מאמרי חדשות מזויפים או פוסטים בתגובות ברשתות חברתיות, שכל כך דומה לטקסט שיצרו בני אדם שיותר מדי מסוכן לשחרר אותו לציבור. "זה נראה מאוד אמיתי, אפשר להשתמש בזה כדי לייצר פייק ניוז באיכות גבוהה", הסביר לוויירד סגן נשיא להנדסה ב-OpenAI, דייוויד לואן. אוקיי, פיתוח מדעי בעל השלכות בעייתיות, אך כזה שיישאר בגבולות האקדמיה.

אף אחד גם לא התרגש יותר מדי כשארבעה חודשים מאוחר יותר שני בוגרי תואר שני במדעי המחשב הצליחו לשחזר את האלגוריתם ולהפיץ אותו בצורה חופשית ברשת. כל אחד יכול לשחזר את זה, הם הסבירו, ולכן הפצת האלגוריתם היא צעד הגיוני ראשון ביכולת להתמודד עם ניצול לרעה שלו. ובאמת, לא נראה שקרה שום אסון מאז כתוצאה.

אולי בגלל זה אף אחד גם לא התרגש כשלפני חודשיים חזרה OpenAI עם אלגוריתם מחולל טקסטים מבוססי בינה מלאכותית חדש, משופר ועצמתי יותר –GPT-3 – ובעיקר עם גישה חדשה: שלמו לנו, ותוכלו להשתמש בו בארגון שלכם לדברים כמו שיפור יכולות חיפוש או מתן פידבקר לתשובות לבעיות מתמטיות.

ואולם, לדברי רנה דירסטה, מנהלת במחקר במכון Internet Observatory של אוניברסיטת סטנפורד ועמיתה בתחום המדיה, מיסאינפורמציה ואמון בקרן מוזילה, היכולת המוצלחת להדהים של האלגוריתם ליצור טקסטים שנראו כאילו נכתבו על ידי בני אדם יכולות להביא ל"עתיד שבו הרוב המכריע של התוכן הכתוב שאנו רואים ברשת נוצר על ידי מכונות". ונכון לעכשיו, היא מזהירה במאמר שכתבה לוויירד, זה צריך להפחיד אותנו הרבה יותר מדיפ פייק של סרטונים או אודיו.

לקראת הבחירות לנשיאות ארה"ב בנובמבר הקרוב, פרשנים ומומחים רבים הזהירו מיכולות AI שמאפשרות ליצור סרטונים או קטעי אודיו שבהם אנשים אומרים דברים שמעולם לא אמרו או עושים דברים שמעולם לא עשו. טכנולוגיות כאלו נמצאות כבר בתפוצה רחבה, כולל כחלק מפלטפורמות פופולריות כמו סנאפצ'ט שמאפשרת להחליף פרצופים של אנשים בתמונות סלפי של המשתמש.

החשש הוא שגורמים זדוניים ינצלו יכולות כאלו על מנת לזייף סרטונים מביכים, מפלגים או מסיתים ויתשמשו בהם על מנת לשבש מערכות בחירות, במיוחד זו הנוכחית בארה"ב, כפי שרוסיה עשתה בהצלחה לא מבוטלת לפני ארבע שנים. אף שעד עתה לא נרשם מקרה בולט מסוג זה (הסרטון שמציג את ננסי פלוס כשיכורה או סובלת ממשבר מנטלי הוא תוצאה של מניפולציות פשוטות כמו האטת קצב הנגינה ואינו דיפ פייק), מדובר בחשש שאי-אפשר לפסול כבלתי סביר.

ואולם, לדברי דירסטה, לא מדובר בדבר המרכזי שצריך להפחיד אותנו. "לווידיאו שנוצר על ידי AI יש איתותים דיגיטליים שכתוצאה מהם התפוקה נראית לא אנושית דיה", היא כתבה בוויירד. "דברים כמו הבעות פנים לא מציאותיות; רינדור כושל של עגיל או שן; העדר פעימות לב, שבהן ניתן להבחין באמצעות שינויים עדינים בצבע העור. על רבים מדברים אלו ניתן להתגבר באמצעות התאמת התוכנה. ב-2018, כשהתברר שה'מצולמים' לא ממצמצים כמו שצריך, הסוגיה תוקנה. אודיו מזויף הוא מורכב יוותר, כשאין מה לראות יש פחות טעויות לתפוס, אך יש מחקרים מבטיחים בתחום. המלחמה בין מזייפים למאמתים בתחום תמשיך כנראה עד אין קץ".

לכך יש להוסיף את העובדה שהמודעות הציבורית לטכנולוגיה גדלה, ואתה גם הספקנות האפשרית כלפי סרטונים שערורייתיים או מלהיטים. אם כבר, הבעיה בהקשר זה היא שדמויות ציבוריות יפטרו סרטונים מרשיעים כ"דיפ פייק", גם כשמדובר בסרטון אותנטי לחלוטין.

הבעיה עם טקסט מתוחכם שיוצרת בינה מלאכותית, אומרת דירסטה, היא חדשה ומורכבת הרבה יותר, שכן אפשר לנצל את יכולות אלו על מנת להשפיע על אנשים בדרכים עדינות הרבה יותר. "יהיה קל לייצר נפח גדול של טקסט, עם הרבה פחות איתותים שיאפשרו את זיהויו. במקום להשתמש ביכולת ברגעים רגישים כדי ליצור מיני-סקנדל או הפתעת אוקטובר (כינוי למידע שנחשף בימים האחרונים של מערכת הבחירות בארה"ב ויכול להפוך את מפת התוצאות. ב-2016 היו אלו הקלטות טראמפ בהם נשמע מדבר בבוטות כלפי נשים ומאוחר יותר הפתיחה המחודשת בחקירה סביב האימיילים של קלינטון), כפי שאפשר ליצור וידיאו או אודיו מזוייפים, בפייק טקסט ניתן לעשות שימוש המוני כדי ליצור מעטה נרחב של שקרים.

"חשיפה להרבה אנשים שמציגים את אותה העמדה, באותו הזמן ובאותו המקום, יכולה לשכנע משקיפים שכולם סבורים כך, בלי קשר להאם האנשים מייצגים עמדה רחבה יותר. בפסיכולוגיה קוראים לזה 'אשליית הרוב'. ככל שהזמן והמאמץ שדרוש על מנת ליצור טקסטים יורד, ניתן יהיה להפיק כמויות אדירות של תוכן מבוסס AI בכל נושא. ייתכן שבקרוב נראה אלגוריתם שסורק את הרשת, מגבש 'דעות' ואז מפרסם תגובות".

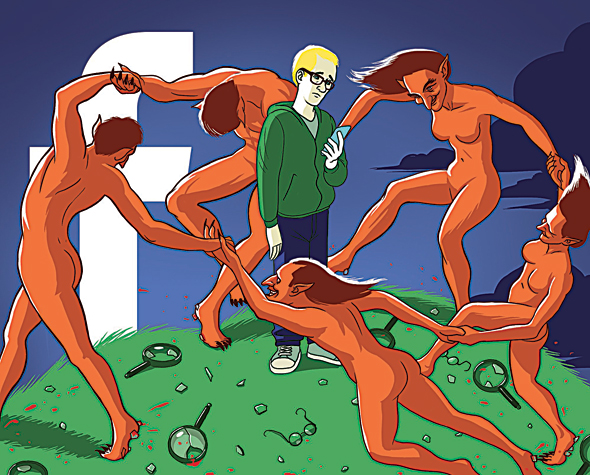

מעבר לולאת המשוב שעלולה להיווצר במקרה כזה – את הפייק טקסט יקראו אלגוריתמים שיגיבו עליו בעוד פייק טקסט וחוזר חלילה עד מות החום של היקום – מזהירה דירסטה מהאופן שבו ניתן להשתמש ביכולות אלו על מנת לעצב את השיח המקוון. כבר היום, נעשה שימוש נרחב ברשתות של בוטים וחשבונות פיקטיביים על מנת להציף את הרשת בפוסטים ובתגובות, למשל סביב נושא או משתמש מסוים, עם טקסטים ממוחזרים או כאלו שעוברים שינוי קל בלבד. הליך התגובות הציבוריות להצעת ה-FCC לבטל את נייטרליות הרשת כלל מאות אלפי תגובות חשודות מסוג זה, שזוהו מכיוון שכללו משפטים ארוכים ורפיטטיביים בעל אופי מלאכותי בעליל.

לפייק טקסט מבוסס בינה מלאכותית אין את הבעיה הזו. "פייק טקסט בלתי-ניתן לזיהוי, בדמות פוסטים ותגובות בטוויטר, פייסבוק רדיט וכו', יכול להיות מעודן, נפוץ וזדוני הרבה יותר", טענה דירסטה. "היכולת לפברק דעת רוב, או ליצור מירוץ חימוש של מגיבים מזויפים, תאפשר ליצור קמפיין השקעה מתוחכם ונרחב. פייק טקסט עלול לעוות את האקוסיסטם של התקשורת המקוונת".

כבר היום אנחנו נאלצים להתמודד עם צבא של בוטים וחשבונות פיקטיביים שצצים בכל חור בשיח המקוון. יש מגבלות שונות שמקילות על הזיהוי שלהם (שם משתמש שמורכב מבליל של אותיות וספרות, חשבון שנפתח לאחרונה, מיעוט חברים או נעקבים, העדר או מיעוט פוסטים מקוריים) ומגבילות את השימוש הנרחב בהם בתלות במשתנים כמו כוח אדם זמין. האפשרות ליצור טקסטים מציאותיים מבוססי AI, שגם מסוגלים להגיב לאירועי השעה, תאפשר לדלג מעל רבות ממגבלות אלו. ניתן יהיה להפעיל חשבונות רבים הרבה יותר עם כוח אדם מצומצם, וליצור מראית עין מוצלחת יותר של חשבון אמיתי. וגם התגובות שיגיעו מחשבונות אלו יכולות להראות מציאותיות ואנושיות יותר, ופחות כמו מחזור של טוקינג פוינטס.

במציאות כזו, יהיה קשה הרבה יותר להבדיל בין משתמשים אמיתיים לפיקטיביים, ובין דעות אמיתיות לעמדות שמנותבות למרכז השיח על ידי בוטים, וכל יוצרות מראית עין של תמיכה נרחבת בעמדה או אדם מסוים, או התנגדות להם. זה לא ישפיע כנראה על המשוכנעים, אבל יכול לדחוף לכאן או לכאן את המתנדנדים. ולא מדובר ביכולות תיאוריטיות. האלגוריתם המקורי שמאפשר את זה זמין ברשת כבר יותר משנה, ועתה ניתן לקבל גישה בתשלום לאלגוריתם המתוחכם יותר. ב-2016, העולם התעורר לסכנות הפייק ניוז כשכבר היה מאוחר מדי. האם זה מה שיקרה השנה עם הפייק טקסט?