שומרת הסף של מיקרוסופט: "פרטיות היא זכות אדם בסיסית"

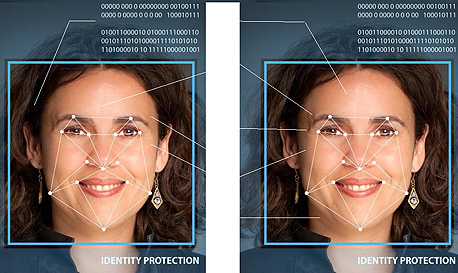

ג'ולי בריל, סמנכ”לית הפרטיות של החברה מודאגת מהשימוש האפשרי בטכנולוגיית זיהוי הפנים של ענקית התוכנה. לדבריה יש לקוחות שמיקרוסופט פשוט לא תמכור להם את הכלי

טכנולוגיה היא כלי עוצמתי לטוב ולרע. הכל תלוי בשאלה מי משתמש בו ואיך. בעבר, השאלה היתה מוגבלת בעיקר לממשלות חזקות עם יכולות טכניות מתקדמות שיכולות להשקיע את המשאבים הדרושים בפיתוח טכנולוגיות חדשות וחזקות. אבל כיום, כשחברות משווקות שפיתחו טכנולוגיות נפיצות כמו זיהוי פנים משווקות אותן ללקוחות בכל העולם, השאלה קריטית הרבה יותר מבעבר.

יש חברות שישווקו את המערכות שלהן כמעט לכל דורש. בחודשים האחרונים נמצאת אמזון תחת מתקפה סביב הנכונותה לספק את מערכת זיהוי הפנים שלה, Rekognition, למשטרה האמריקאית חרף הכשלים שזוהו בה ותוך התעלמות משימושים בעייתים שיכולים להיעשות בה.

מצב כזה מדאיג מאוד חברות כמו מיקרוסופט, שתומכות בגישה זהירה יותר בכל הנוגע למתן גישה לטכנולוגיות שיוצאות תחת ידה. "כשממשלות ולקוחות אחרים מבקשים להשתמש בטכנולוגיית זיהוי הפנים שלנו, אנחנו בוחנים מה אנחנו חושבים שהם יעשו אתה, ולפעמים אנחנו אומרים - 'לא’", סיפרה סמנכ"לית הפרטיות של מיקרוסופט, ג'ולי בריל, בראיון ל"כלכליסט". "אנחנו מודאגים מהשימוש בה. אנחנו רוצים שהממשלה הפדרלית תקדם חקיקה שתטיל רגולציה על זיהוי פנים כי אנחנו מבינים שמדובר בטכנולוגיה חשובה ומועילה שאפשר גם לנצל אותה לרעה".

לבריל, שמכהנת גם כמשנה ליועץ המשפטי של מיקרוסופט, היכרות עמוקה עם סוגיות פרטיות ורגולציה משני צדי המשוואה. בין 2016-2010 היא כיהנה כאחת הנציבים ב-FTC, נציבות הסחר הפדרלית, שם הובילה את הטיפול בסוגיות טכנולוגיה ופרטיות. קודם לכן עבדה במשך יותר מ-20 שנה במשרד תובע המדינה של ורמונט, שם הובילה סוגיות כמו הגנת צרכן ותחרותיות. למיקרוסופט הצטרפה לפני כשנתיים, אחרי שנה כשותפה במשרד עורכי הדין Hogan Lovells, שם עמדה בראש מחלקת הפרטיות והסייבר.

חשש ממעצר חפים מפשע

ההבטחה של בריל, לפיה מיקרוסופט לא תמכור את טכנולוגיית זיהוי הפנים שלה לכל אחד היא לא סתם מילים ריקות: רק השנה סירבה החברה למכור את המערכת לסוכנות אכיפת חוק בקליפורניה, שביקשה לשלב אותה במצלמות רכב וגוף של שוטרים, בשל החשש לפגיעה בזכויות אדם. "זה חשוב שלכל חברת טכנולוגיה שמספקת כלים עוצמתיים כאלו יהיו עקרונות לגבי זכויות אדם שעלולות להיפגע משימוש בטכנולוגיה", אמרה בריל. "עם זאת, למיקרוסופט חשוב לספק את הטכנולוגיה הטובה ביותר לדמוקרטיות בעולם".

למיקרוסופט יש מדיניות שלא למכור טכנולוגיות מסוימות לממשלות לא-דמוקרטיות?

"לא. אנחנו רוצים לוודא שבכל טכנולוגיה שאנו מספקים לממשלה, או לכל לקוח אחר, יעשה שימוש שיכבד זכויות אדם".

יש טכנולוגיה שתמכרו לממשלת ארה"ב אבל לא למדינות כמו ערב הסעודית?

"אני לא אגיב בנוגע למדינה ספציפית. אנחנו רוצים לוודא שזכויות אדם מכובדות, וזה חלק מהליך הבחינה של בקשות להשתמש בטכנולוגיה שלנו".

יש לכם כללים אתיים, כמו 'לא נמכור טכנולוגיה שתשמש להרג אנשים'?

"יש לנו עקרונות ברורים מאוד בסוגיות האלה. אנחנו בוחנים האם יישום מסוים עומד בהם".

איזה משקל אתם נותנים למה שאומרים העובדים שלכם בקבלת ההחלטות הללו? אם הרבה עובדים יגידו שהם נגד מכירת טכנולוגיה לגוף מסוים, תקשיבו להם?

"אנחנו מכבדים מאוד את העובדים שלנו, הם החלק הכי חשוב במיקרוסופט. אנחנו מקיימים איתם דיאלוג קבוע. אם עובד לא רוצה לעבוד על פרויקט מסוים, הוא לא חייב לעבוד עליו וזה לא יביא לפיטוריו. זה מנגנון הגנה חשוב. כמובן שאנחנו מקשיבים להם, משלבים את החששות שלהם בעקרונות שלנו".

אחד השיקולים שבגינם סירבה מיקרוסופט למכור את התוכנה לגוף משטרתי מעניין במיוחד: נשיא מיקרוסופט בראד סמית הסביר שבחברה חששו שהשימוש המשטרתי יוביל למעצר לא פרופורציונלי של נשים ומיעוטים חפים מפשע, שכן המערכת אומנה בעיקר על תמונות של גברים לבנים. זו הודאה חשובה במגבלות המערכת (כזו שאמזון, אגב, מסרבת לעשות), שגם מדגימה את אחת הבעיות המוכרות בפיתוח בינה מלאכותית מבוססת למידת מכונה: הטיית דעה של המערכת שהוזנה במידע שאינו מגוון דיו.

זו בעיה שלדברי בריל מכירים במיקרוסופט היטב. "צריך לטפל בהטיית דעה בבינה מלאכותית בדרכים שונות", אמרה. "צריך להתייחס למידע שמשמש לאימון הבינה המלאכותית, והמידע נוצר לרוב על ידי המהנדסים עצמם. בין אם מדובר בתמונות למערכות זיהוי פנים או אפילו ניתוח התוצאות. חשוב לחשוב באופן מכיל על איך לפתח מערכת הוגנת. צריך לבחון את המידע ולהיות זהיר אתו, אבל צריך גם לחשוב על כוח העבודה ולוודא שהוא כולל מגוון גדול ככל האפשר. אנשים מביאים נקודות מבט שונות כשהם בוחנים את התוצאות של בינה מלאכותית, והגיוון הזה יסייע לוודא ככל האפשר שהתוצאות לא מוטות"

פרספקטיבה שונה משל גוגל

בריל הצטרפה למיקרוסופט כחצי שנה בלבד לפני שפרשת קיימברידג' אנליטיקה שינתה את ההתייחסות והעניין בפרטיות מקוונת ובמידע שחברות ענק אוגרות ומעבדות. אך לדבריה, מיקרוסופט לא נדרשה לשינויים רבים בעקבות הפרשה: "מיקרוסופט קוראת לחוקק חוק פדרלי חזק בנושא פרטיות מאז 2005. לתפיסתנו פרטיות היא זכות אדם בסיסית. לא שינינו את נקודת המבט שלנו לגבי פרטיות, ואנחנו מטמיעים את עקרונות הפרטיות שלנו בעולם שבו חוקי פרטיות נוצרים ורגולטורים יותר מעוניינים בהם.

"כשמתווה GDPR של האיחוד האירופי נכנס לתוקף במאי 2018, הכרזנו שניישם את עקרונות הליבה שלו גלובלית, לא רק בנוגע לאזרחי אירופה, ישראל או ארה"ב. זה היה מקרה שבו לקחנו את התפיסה שלנו, שפרטיות היא זכות אדם, והטמענו אותה בעולם הגנת הפרטיות. זה לא שמיקרוסופט השתנתה - העולם משתנה, רגולטורים של פרטיות השתנו, אבל למיקרוסופט יש את עקרונות היסוד שלה ובכוונתה להטמיע אותם כדי להגיב לחוקים שנוצרים".

למה גוגל ופייסבוק, בניגוד למיקרוסופט, מתקשות כל כך בנושא?

"לנו יש מודל עסקי שמתמקד בהרבה לקוחות מסוגים שונים. אנחנו משרתים עסקים אחרים, יש לנו גם אינטראקציה ישירה עם לקוחות. הפורטפוליו שלנו רחב מאוד, וזה מאפשר לנו לראות ולזכות לפרספקטיבה שבה אנחנו מגינים על פרטים, אבל גם יכולים לסייע לעסקים אחרים להגן על המידע של הלקוחות שלהם".