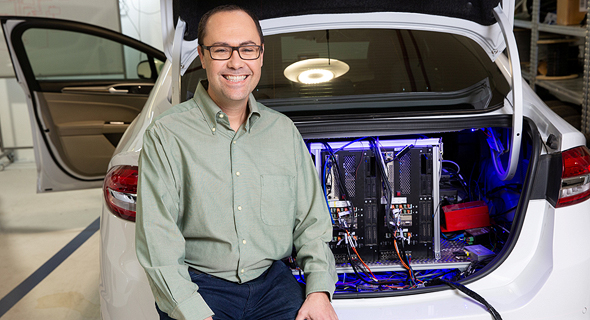

בכיר מובילאיי: "הפכנו את האינטואיציה האנושית לנוסחאות מתמטיות"

פרופ' שי שלו שוורץ, סמנכ"ל הטכנולוגיה של החברה, מסכים שטכנולוגיית הבינה המלאכותית שבלב הרכב האוטונומי לא מספיק טובה ליישום המהפכה. הפתרון של החברה: קביעת חמישה חוקי "שכל ישר" לנהיגה בטוחה ונוסחאות פשוטות, שיאפשרו לרכב לציית ולציבור - להבין מה קורה בתוך המחשב

שנת 2019 הגיעה, אבל המכוניות האוטונומיות עדיין לא שועטות בכבישים. המבקרים של חזון המכוניות האוטונומיות מצביעים על סיבה ברורה לכך: למידה עמוקה, כלי הבינה המלאכותית שבלב מערכות התוכנה של המכוניות ללא נהג, פשוט לא מסוגלת לעמוד במעמסה של יצירת רכב אוטונומי מלא. הכלי קהה מדי, לא מסוגל להתמודד עם מצבי קיצון לא צפויים, והליך קבלת ההחלטות שלו אינו שקוף. הוא פשוט לא מסוגל לספק את רמות הביטחון והאמון הנדרשות להשקה רחבה של מכוניות אוטונומיות. לטענת המבקרים, כדי באמת להגשים את החזון החברות הפועלות בתחום חייבות לפתח גישה חדשה.

בשנה האחרונה הטיעון הזה צבר יותר ויותר תומכים, בעיקר אחרי התאונה הקטלנית שבה מכונית אוטונומית של אובר הרגה הולכת רגל בתחילת השנה. גם ההשקה המאכזבת יחסית בדצמבר של שירות המוניות הרובוטיות של וויימו בפיניקס, שהראתה עד כמה הטכנולוגיה רחוקה מהבטחות היצרניות בתחום, לא סייעה לאמון.

מטבע הדברים, גורמים רבים בתעשייה דוחים באופן גורף את הביקורת, אבל דווקא במובילאיי, מהשחקניות הבולטות והמובילות בתחום, מקבלים אותו במלואו. בראיון בלעדי לכלכליסט מודה סמנכ"ל הטכנולוגיה של החברה, פרופ' שי שלו שוורץ, שיש בעיות עם למידה עמוקה ושנדרש מודל חדש.

ואולם, יש לו גם טוויסט: לדבריו, מובילאיי כבר פיתחה את המודל החדש הזה באמצעות קביעת נוסחאות מתמטיות, והוא צפוי לאפשר לה לעמוד בלוח הזמנים הקפדני של השקה רחבה של מכוניות אוטונומיות כבר בתחילת העשור הקרוב. "אם המהפכה תתעכב זה לא יהיה כי הטכנולוגיה לא שם", הוא מבטיח.

"ללמידה עמוקה קשה לטפל במצבי קיצון"

במובילאיי ובחברה-האם אינטל מכירים היטב את עולם ה־AI בכלל והלמידה העמוקה בפרט. "שימוש ב-AI ובאלגוריתמים של למידה שמבוססים על ביגדאטה נפוץ באינטל ובמובילאיי", אומר שלו שוורץ. "בדצמבר קיימה אינטל כנס AI למאות מעובדי החברה, ובו נחשפו בפני העובדים שימושים רבים של בינה מלאכותית באינטל ובמובילאיי.

"למידה עמוקה אינה הפתרון לכל הבעיות בעולם, זה פשוט לא נכון מבחינה מדעית", אמר שלו שוורץ. "זו טכנולוגיה שעשתה מהפכה והעניקה לנו יכולות חזקות בהרבה משהיה קודם, אבל היא רחוקה מלהיות פתרון מושלם. יש בעיות פשוטות יחסית שהיא פשוט לא מסוגלת לפתור".

בפשטות, למידה עמוקה היא טכניקה שמשמשת ללמד מחשב לזהות דפוסים על בסיס סריקת מאגר עצום של דוגמאות מתויגות, כמו מאגר של תמונות כביש שבמידע המצורף לכל תמונה מצוין אם מופיע בה הולך רגל או לא. אלגוריתמים יעודיים ממנפים את הלמידה כדי לבצע פעולות חדשות, כמו לזהות הולך רגל בתמונה חדשה שהמערכת לא ראתה קודם לכן.

לדברי שלו שוורץ הבעיה היא שלמידה עמוקה מסתכלת על המקרה הממוצע: "אם שואלים את רשת הנוירונים שנוצרה בהליך הלמידה האם יש הולך רגל בתמונה החדשה, בממוצע התשובה שלה תהיה נכונה. זה יכול להיות נכון ב־99% או ב99.9% אבל עדיין מדובר רק בהתנהגות ממוצעת ולא בסיפוק תשובה נכונה ב־100% מהמקרים. כך פותחה ונבנתה הטכנולוגיה. ברגע שאתה מבין אתה תוהה איך זה יכול לעבוד בתעשיית הרכב, שבה צריך 100% הצלחה. התשובה היא שללמידה עמוקה יהיה קשה לטפל במקרי הקיצון, וזה מקור הביקורת".

ביקורת נוספת תוקפת את היות מערכות הלמידה העמוקה מעין קופסה שחורה שאי אפשר לדעת איך מתקבלות בהן החלטות. "כששמים מכונית אוטונומית על הכביש רוצים להיות שקופים ולהגיד לציבור בדיוק לפי איזה כללים ה-AI מקבלת החלטות; מתי היא מחליטה שמסוכן וצריך לבלום ומתי זה בסדר. צריך להגדיר במדויק את השכל הישר של המכונה, וזה דבר שכיום הוא מעבר ליכולות הלמידה העמוקה", הסביר שלו שוורץ.

איך הופכים שמירת מרחק לכלל מתמטי קל לציות

הפתרון של מובילאיי? מודל AI שלא מבוסס על למידה עמוקה אלא על הוכחות מתמטיות: "אנחנו רוצים רשת ביטחון שאומרת שיש פה שכל ישר וברור שהגדיר דברים שאסור לעשות ודברים שצריך לעשות, ושאנחנו רוצים לציית לו בכל מחיר. פיתחנו לכך מודל בשם RSS (קיצור של Responsibility, Sense and Saftey), שהופך לנוסחאות מתמטיות, מושגי שכל ישר כמו מה זה להיות זהיר בכביש, מהו מצב מסוכן בכביש ומה התגובה הנאותה למצב מסוכן. זו לא אינטואיציה אלא משהו ברור ומדויק שאתה יודע מה נכנס אליו ויודע מה יוצא".

"למשל, אנחנו רוצים לקבוע מתי מצב בכביש נחשב למסוכן. כולנו למדנו על שמירת מרחק, אבל מתי בדיוק המיקום והמהירות של רכב א', שנוסע מאחורי רכב ב', הופכים למסוכנים? גם עבור בני אדם לא כל המצבים הם ברורים. לכן אנחנו 'מפרמלים' את זה, כלומר הופכים לפורמולה, מודל מתמטי. זה הליך שמאפשר להכניס למודל את משתני המיקום והמהירות של שתי המכוניות ולקבל תמיד תשובה מדויקת, האם המצב מסוכן או לא. כמובן שהתנהגות בכביש הרבה יותר מורכבת ולא טריביאלי לפרמל את כל חוקי השכל הישר בצורה מדויקת כדי שנוכל לומר שמכונית עם AI היא מכונית זהירה".

איך התהליך הזה עובד? איך לוקחים אינספור משתנים לא ידועים שהם למעשה אינטואיציה והופכים אותם לנוסחה?

"זה ההליך המדעי. גם לפני שניוטון פיתח את תיאוריית המכניקה הקלאסית, אנשים רבים הבינו לפי אינטואיציה שאם עוזבים משהו הוא יפול לרצפה. אך איש לפניו לא הצליח להפוך את זה לנוסחה מתמטית פשוטה ואלגנטית. עבודת המדען היא לבחון את הפרטים הרבים ולמצוא את החוק הפשוט שמגדיר אותם.

"ישבנו ובחנו תופעות כדי למצוא כללים פשוטים שמסבירים את האינטואיציה. ריכזנו אוסף של כללים, נוסחאות, מצבים מסוכנים, הגורמים שמשפיעים עליהם והמשתנים הרלבנטיים. הצלחנו לפרמל את כל הסיפור במספר מצומצם של נוסחאות מתמטיות קומפקטיות. אחרי זה לקחנו מאגר מידע של שישה מיליון דיווחי משטרה על תאונות דרכים בארה"ב ובדקנו מולו את הנוסחאות שחיברנו כדי לוודא שהמודל שלנו נכון".

בסך הכל ניסחו במובילאיי חמישה חוקים והתאימו להם נוסחאות מתמטיות. "החוק הראשון הוא אל תתנגש במישהו מאחור. שכל ישר", אומר שלו שוורץ. "צריך להגדיר את זה בצורה מדויקת כי החוק לא תמיד נכון, כמו מצב שבו אני נוסע מאחוריך, ולפתע אתה עוצר, מעביר לרברס ונוסע אחורה. במצב כזה גם אם אני עומד במקום עדיין נתקעת בי, וזו לכאורה כניסה מאחור, ולכן צריך להגדיר את גבולות החוק.

"בסיטואציה רגילה שתי מכוניות נוסעות זו אחר זו באותו כיוון. על הרכב האחורי מוטלת החובה לשמור על מרחק מספק כדי לא לפגוע מאחור ברכב שנוסע לפניו. כדי להפוך את זה לנוסחה מתמטית אנחנו בוחנים את התרחיש הגרוע ביותר, בלימה פתאומית של הרכב הקדמי. במצב כזה הרכב האחורי נדרש לזמן תגובה שלאחריו הוא יבלום, ואז חוקי התנועה של ניוטון קובעים איך שתי המכוניות ינועו עד לעצירה מוחלטת. אם הן מגיעות לעצירה בלי התנגשות אז המצב אינו מסוכן, ואם הן התנגשו אז הוא מסוכן.

"על בסיס זה מייצרים נוסחה שאומרת שכל עוד המרחק בין המכוניות גדול מ־X המכוניות תמיד יעצרו ללא התנגשות, ואם הוא קטן מ־X הן כן יתנגשו ואיך צריך הרכב האחורי להגיב במצב זה. בהגדרה נכונה אפשר להוכיח שכשהרכב האחורי מקיים את תנאי החוק הוא לעולם לא ייפגע ברכב אחר מאחור. עשינו זאת, בנינו את הנוסחה הנכונה. זה אומר שיש לנו משהו שקוף שמראה בדיוק מה אנחנו מבטיחים. זה מעוגן בנוסחה מתמטית שמהנדסים ומתמטיקאים יכולים לקרוא ולבחון, אבל לא צריך את הנוסחה כדי להבין את ההבטחה, מספיק שכל ישר".

"אם המהפכה לא תגיע זה לא יהיה בגלל הטכנולוגיה"

החוקים הנוספים שניסחה מובילאיי הם לא לחתוך רכב אחר בצורה חסרת זהירות, ניסוח מתמטי של מתן זכות קדימה, משמעות הזהירות בקרבת אזורים נסתרים (כמו רכב חונה שעשוי להיות מאחוריו ילד שעלול לרוץ לכביש) והחובה למנוע תאונה במקרה שנכפה על הרכב מצב מסוכן. "זה כמו חוקי הרובוטיקה על אסימוב, אבל בצורה מדויקת ומתמטית שמותאמת לרכב אוטונומי", אמר שלו שוורץ.

ככל שהזמן חולף גובר הרושם שיצרניות הרכב האוטונומי לא יעמדו בהבטחות להשקה רחבה עד 2022. אתה מאמין שיש סיכוי לעמוד בדדליין הזה?

"היתה בתחום התקדמות אדירה, אנחנו רק בשלהי 2018 (הראיון בוצע בדצמבר - ע"כ) ולא יפתיע אותי אם כן יעמדו בזמנים. מובילאיי מתכוונת להוציא מונית אוטונומית לרחובות תל אביב ולערוך בה ניסויים ראשונים ב-2019".

הטכנולוגיה נראית די ראשונית. שירות המוניות האוטונומית של וויימו בפיניקס סובל מבעיות רבות, המכוניות או זהירות מדי או מגיבות בפתאומיות. זה נראה לא אפוי מספיק.

"קשה לבנות רכב אוטונומי בלי להגדיר את הגבול בין פרנויה לזהירות כפי שעושים נהגים אנושיים. או שתקבל רכב לא זהיר שיעשה תאונות או רכב מאוד הססן. יצרנו את מודל RSS והנוסחאות המתמטיות כי הבנו שאם יצאו לנו מכוניות הססניות שתוקעות את התנועה איש לא יקבל את זה. וכמובן שאיש לא יקבל רכב חסר זהירות. הנוסחאות מאפשרות לנו לעשות את האיזון הנכון.

"ברגע שאתה מבצע איזון אתה צריך להגיד את זה לציבור, ולכן עשינו את המודל שקוף. אני אומר לך מה אני עושה וטוען שזה איזון טוב. זה מאפשר לציבור להגיד אם זה הגיוני או לא. אנחנו רוצים שיתפתח שיח בין היצרן לציבור עד להגדרת רגולציה שתקבע את האיזון. זה הפתרון לבעיה שאתה מתאר.

"הטכנולוגיה מתקדמת במהירות, עצם זה שיש מכוניות אוטונומיות על הכביש זה דבר שלפני 10 שנים נראה כמדע בדיוני. תמיד בישורת האחרונה, במיוחד בנושאים שיש בהם סוגיות של בטיחות, יש אלמנטים שדורשים קבלה מהציבור. אולי נדרשת רגולציה ואולי סתם הבנה שאנחנו כבני אדם מקבלים את הטכנולוגיה ולא מפחדים ממנה. לתקשורת ולרגולטורים יש תפקיד חשוב בשאלת השאלות הקשות כדי לדעת איך אנחנו מתמודדים עם הסוגיות השונות".

להערכתך פריסה המונית של רכב אוטונומי מלא אפשרית כבר בחצי הראשון של העשור הבא?

"זה ודאי אפשרי טכנולוגית, אבל אם זה לא יקרה זה לא בהכרח כי הטכנולוגיה לא תהיה בשלה. זה יכול להיות מסיבות רגולטוריות או עסקיות. אנחנו מתקרבים לרגע שבו הטכנולוגיה תהיה מספיק בשלה, ואני מאמין שכשזה יקרה וכשלאנשים יהיה אמון במערכת בגלל השקיפות שהכנסנו בה, זה יוביל למעבר פאזה. בהתחלה יהיה טפטוף, אבל אז אנשים יראו שהטכנולוגיה אמינה, הגיונית, נוחה ומהנה וירצו להצטרף למהפכה. קצת כמו שקרה עם הסמארטפונים, בהתחלה הם היו נישה אבל אחרי מספר שנים הם הפכו למוצר צריכה".