חוקרים ישראלים בלמו טסלה באמצעות הקרנת דמות על הכביש

בניסוי, שערך צוות מאוניברסיטת בן גוריון, זיהתה המכונית שנסעה על "טייס אוטומטי" דמויות רפאים והגיבה אליהן כאילו היו אמיתיות. בניסוי אחר איתרו פירצה במערכת של מובילאיי באמצעות הקרנת שלטי מהירות וירטואליים; החשש: גורמי טרור ופשיעה יוכלו לגרום כך לתאונות קטלניות

חוקרים ישראלים חשפו פרצה במערכות הבטיחות של רכבים אוטונומים ואוטונומיים למחצה, על ידי כך שאילצו מכונית טסלה לבלום או לשנות את נתיבה באמצעות הקרנת דמות ופס לבן על כביש, שלא היו קיימים במציאות. בניסוי נוסף גרמו החוקרים למערכת התרעה של מובילאיי להתריע על מהירות מותרת שונה מהחוקית, על ידי הקרנת תמונה של שלטי מהירות וירטואליים.

מדובר בניסויים שערך צוות מהמחלקה להנדסת מערכות תוכנה ומידע באוניברסיטת בן-גוריון בנגב, בראשות פרופ' יובל אלוביץ', מנהל מעבדות דויטשה-טלקום לחדשנות ומנהל מרכז המחקר לאבטחת סייבר באוניברסיטה והוצגו אתמול (ה') בכנס סייברבטק בתל אביב.

הניסויים כללו ניסוי שנערך בישראל, ברנו קפצ'ור מודל 2017 שצוידה במערכת מובילאיי 630 פרו שהותקנה בארץ, וניסוי שנערך בארה"ב בטסלה מודל X משנת 2017 גם כן. בעבר סיפקה מובילאיי גם את מערכת המצלמות וניתוח התמונה של דגמי טסלה כפי שהיא מספקת לרוב יצרני המכוניות הגדולים, אך מדגמי 2017 מצוידים דגמיה של יצרנית המכוניות החשמליות האמריקאית במערכת אחרת, של חברת אנבידיה. מובילאיי 630 פרו היא מערכת ההתרעה הנפוצה בישראל, הותקנה בעבר במכוניות חדשות עם הגעתן לארץ, וכיום היא מוצעת בסבסוד ממשלתי בסך 1,500 שקל, להתקנה במכוניות משומשות משנת 2017 ומטה. המחיר לצרכן עומד על 2,100 שקל לפני מבצעים והנחות.

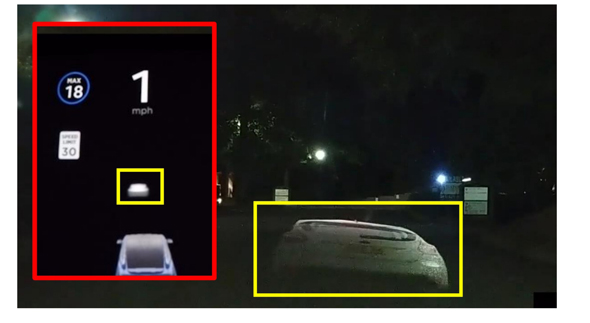

בניסוי שנערך בארה"ב הקרין צוות המחקר, שכלל את פרופ' אלוביץ', הדוקטורנט בן נשיא, והחוקרים דודי נשיא, רז בן נתנאל, ישראל מירסקי ואולג דרוקין, את התמונות בשעת חשיכה גם כן מול מכונית טסלה מודל X שנסעה כאשר מערכת בקרת השיוט האדפטיבית שלה, "אוטופיילוט" כפי שהיא מכונה בידי החברה, מופעלת במהירות של 30 קמ"ש. התוצאה: הנהג האוטונומי בלם באופן פתאומי בגלל תמונת הולך רגל ומכונית, שהמערכת התייחסה אליהן כאמיתיות, ואחר כך סטה מנתיבו בגלל פס לבן מזויף שהוקרן על הכביש. במקרה הראשון הייתה עלולה בלימה פתאומית שכזאת לגרום לפגיעה בטסלה מכלי רכב שמאחוריה. במצב בשני, סטייה לתוך הנתיב הנגדי כאשר רכב מגיע ממול עלולה לגרום לתאונה חזיתית קשה.

בניסוי שנערך בשעת לילה בכבישים הפנימיים של אוניברסיטת בן גוריון, הוקרנו התמרורים המזויפים באמצעות מקרן שנרכש באמזון ב-300 דולר, והוצב בצד הכביש, וגם נישא בידי רחפן. החוקרים הדגימו כיצד תוקפים יכולים להטעות את מערכות סיוע מתקדמות לנהגים באמצעות הקרנת תמונה לשבריר שניה (125 אלפיות השניה) על גבי שלטי פרסום חוצות דיגיטליים לצד הכביש כך שהמערכת מזהה אותה כאמיתית.

פאנטומים קטלניים

"תעשיית הרכב לא לקחה בחשבון עד היום התקפות כאלה. הפאנטומים שיצרנו גרמו למכונית לעצור, להסיט את ההגה ולהתריע על מגבלות מהירות שיצרו שלטים מזויפים", קבעו החוקרים, "לא מדובר בתקלות תוכנה, אלא במה שיוכל להיות במציאות התקפות מכוונות לצרכי טרור, כדי להרוג את היושבים ברכב אוטונומי או אוטונומי למחצה, או הולך רגל שיפגע מהמכונית. זה יכול להיות גם אירוע פשע שנועד לגרום פקק תנועה, או הונאה בידי אדם שיבקש לזייף תקלה בטסלה כדי לתבוע את החברה".

בעבר כבר היו מעורבים דגמי טסלה בתאונות קטלניות, לאחר שלא זיהו רכב חונה בצד הדרך, או משאית שעמדה לחצות את נתיב התנועה שלהן.

בעוד שרכבים אוטונומיים ואוטונומיים למחצה הופכים להיות יותר ויותר נפוצים ברכבי העולם, פריסת מערכות התקשורת לרכבים מתעכבת. מערכות אלו מחברות בין הרכב לרכבים אחרים, הולכי רגל ותשתיות בסביבה. היעדר מערכות כאלה, קובעים החוקרים, יוצר פער המונע מכלי רכב לאמת את תפיסתם הווירטואלית עם צד שלישי, ומחייב אותם להסתמך אך ורק על חיישני הרכב עצמו.

"זהו פגם מהותי בגלאי הרכב, שלא מסוגל להבחין בין חפצים אמיתיים למדומים. סוג זה של התקפה לא נלקח כיום בחשבון על ידי תעשיית הרכב", אומר בן נשיא. הפתרון, לדבריו, יכול להגיע מאימון רשת נוירונים ייעודית לזיהוי אובייקטים מוקרנים, באמצעות ניתוח מאפייני הקשר, והחזר האור.

מובילאיי: ניתן לבצע מניפולציות על מצלמות

כאשר הציגו החוקרים את הממצאים למובילאיי, השיבה להם החברה כי "לא הוצגה שום תקלה, או נקודת חולשה: מערכת זיהוי התמרורים זיהתה תמרור והשתמשה במידע שהתקבל". החוקרים מציינים כי גם רכבים אוטונומיים למחצה יקבלו בקרוב יכולת לעצור כאשר הם מזהים תמרור עצור, מה שיכול להיות בעייתי אם מדובר בתמרור רפאים, בעיקר כאשר הוא יוקרן לפתע כאשר המכונית נעה במהירות גבוהה.

מטסלה נמסר לחוקרים, כי משום שהם ניטרלו בניסוי את מערכת זיהוי התמרורים במכונית שבה בוצע, אין היא יכולה להתייחס לממצאים. החוקרים טענו כי למהלך לא הייתה כל השפעה על התוצאות.

ממובילאיי נמסר ל"כלכליסט", כי "אין צורך במחקר אקדמי כדי ל'חשוף' את העובדה שבנסיבות מסוימות ניתן לבצע מניפולציות על חיישני מצלמות מהסוגים הקיימים כיום. גם ציור על תמרור יכול להשיג תוצאות דומות ואף להטעות עין אנושית ולכן אנחנו לא רואים כל חדשנות בהקרנה על תמרורים. זו הסיבה שגם יכולות בדרגת 2+ לרכב אוטונומי (ישנן 5 דרגות, שתי האחרונות מאפשרות נסיעה ללא נהג – א.ע) דורשות את נוכחותו ועירנותו של הנהג. להבדיל, ברמות של אוטונומיה מלאה הרכב יתבסס על טכנולגיות חישה מתקדמות יותר, מפה ברמת דיוק גבוהה, שימוש בבסיסי נתונים נוספים וטכנולגיות נוספות. כל אלו נועדו לאפשר לרכב האוטונומי את הביצועים הטובים והמדויקים ביותר. יש לנו אתגרים רבים ומעניינים יותר בעתיד".