בהשראת אסימוב: מכון התקנים הבריטי פרסם קוד אתי לרובוטים

קבוצה של מדענים ומומחי אתיקה גיבשה תקן רשמי שכולל כללי הפעלה וייצור של מערכות בינה מלאכותית, לצד ציון הסכנות הכרוכות בשימוש בהן, ביניהן הונאה רובוטית, התמכרות לבינה מלאכותית ורובוטים מורדים

מכון התקנים הבריטי פרסם מסמך שאמור לטפל בבעיות האתיות הנובעות משימוש ברובוטים ומיועד ליצרנים. התקן החדש פורסם באפריל האחרון, ועל פי דיווח של "הגארדיאן" מהיום (א') נכתב על ידי ועדה של מדענים, אנשי אקדמיה, פילוסופים ומומחי אתיקה. התקן מזכיר מאוד את העבודה של סופר המד"ב, אייזק אסימוב, שהיה הראשון להגות חוקי פעולה לרובוטים בהם: איסור על רובוט לפגוע בבן אנוש, חובה על רובוט להישמע להוראות בן אנוש וחובתו של הרובוט לשמור על עצמו.

מפרסמי התקן כתבו שהתפתחות הרובוטיקה והבינה המלאכותית העלתה את הסכנות שכרוכות בשימוש בהם. מכון התקנים ציין שמדובר בסוג של קוד אתי, אך הוא כולל גם כללי הפעלה שאמורים לשמור על בטיחות המשתמשים. התקן עצמו מיועד אמנם ליצרנים ומפתחים, אך כותביו ציינו שהוא אמור להרגיע את הצרכנים בבואם לרכוש מוצר רובוטי.

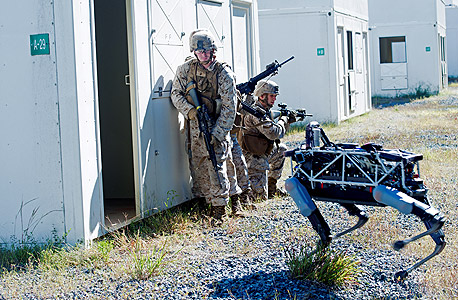

בין הסכנות שהכותבים מציינים ניתן למנות הונאה רובוטית, התמכרות וכן את האפשרות שמערכות בעלות יכולת לימוד עצמאית ישנו את ייעודן. התקן הבריטי מהווה מסמך מפורט הרבה יותר מחוקי הרובוטיקה של אסימוב, הוא משתמש במבנה דומה - שהולך מהכללי אל הפרטי. למשל, הוא מציע בכללי הבסיס שלו מספר חוקים שדומים מאוד לאלה של אסימוב: אסור לפתח רובוטים שייעודם פגיעה או הריגה של בני אדם; בני אדם ולא רובוטים הם האחראים על פעולתם; יש לאפשר זיהוי של מפעיל הרובוט והוא האחראי על פעולותיו.

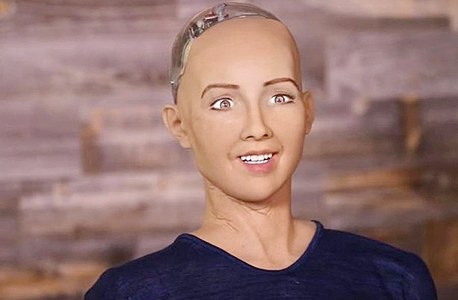

התקן גם מתייחס למקרים בהם האדם עשוי להיקשר באופן רגשי לרובוט במהלך השימוש, תוך התייחסות למקרים של ילדים וזקנים. המדענים ציינו בהקשר זה מחקר שבוצע בגן ילדים בו הוטמעו רובוטים, לדברי פרופסור נואל שארקי מאוניברסיטת שפילד, המחוקרים מצאו שהילדים נקשרו רגשית לרובוטים ואפילו מייחסים להם יכולות קוגניטיביות גבוהה יותר מזו של חיות מחמד. "מדובר בדוגמה למצב של הונאה רגשית", הסביר שארקי.

התקן שואף שהיצרנים יהיו שקופים יותר לגבי הרובוטים שהם מפתחים, אך הם הודו שמדובר בדרישה בעייתית, בעיקר במקרה של מערכות לימוד עמוק (deep learning), שאפילו המפתחים לא יודעים תמיד למה הן מקבלות את ההחלטות שלהם. מערכות כאלה מנסות לפתור או ללמוד כיצד לבצע פעולה על ידי ניסוי וטעייה, תהליך שדורש לפעמים מיליוני ניסיונות. הפתרון שנמצא אינו תמיד משהו שהמפתחים ציפו לו או אפילו מבינים אותו.

התקן מתייחס גם להיבט הגזענות או הסקסיזם שעשוי לבווא לידי ביטוי במסגרת השימוש במערכות בינה מלאכותית. הם ציינו שמדובר בבעייה שמשטרות עשויות להידרש אליה. דוגמה טובה לכך ניתן למצוא בבוט שמיקרוסופט פיתחה והחל לפתח התנהגות ותגובות גזעניות, מה שהכריח את החברה להשבית את הפעולה שלו.

"מערכות מעין אלה מוטות לגברים לבנים בגילאי 25 עד 45 מהמעמד הבינוני", הסביר אלן ווינפילד, פרופסור לרובוטיקה מאוניברסיטת ווסט אנגליה. "טכנולוגיות שהופעלו בנמלי תעופה נטו להזהיר יותר מפני אנשים שלא ענו לפרופיל הממוצע", הוסיף שארקי, "ניתן לראות בזה סוג של פרופיילינג גזעני". התופעה חזרה על עצמה במערכות רפואיות, שם נוצרה בעיה בזיהוי יעיל של נשים ושחורים.

"אנחנו צריכים סוג של קופסה שחורה לרובוטים", הסביר שארקי, "אם מוצאים שרובוט משטרתי הפך לגזעני, אנחנו רוצים לדעת את זה על מנת לכבות אותו". החוקרים גם התייחסו למצב של הסתמכות יתרה על רובוטים ומצאו שמדובר בבעיה שעשויה להשפיע על החברה. "אם אתה עובד עם רובוט ומסתמך על תשובותיוכל הזמן אתה עשוי להתעצל במשך הזמן ואז לא תשים לב כשהוא יספק לך תשובה ממש טפשית", הסביר שארקי.

ולבסוף, ישנה סכנה שהרובוטים יצאו משליטה. מצב זה, שהיווה בסיס לאינספור ספרים וסרטי מד"ב, החל מ"אודיסיאה בחלל 2001" ועד "אקס-מכינה" מהשנים האחרונות, הוא אחד המדאיגים ביותר, גם עבור המדענים. "הבעיה העיקרית היא שרובוטים מורדים עשויים למצוא דרכי פעולה שהמפתחים שלהם לא השכילו לחזות", נאמר בתקן, "לפעולות אלה עשויות להיות תוצאות לא רצויות, מה שמעלה את נושא האחריות המשפטית של הפעלת רובוטים כאלה".