דוח טכנולוגי

רגע, יכול להיות שלצ'טבוט של גוגל באמת יש רגשות?

בלייק למויין, המהנדס בחברה שטען שהצ'טבוט שלה הוא אדם בעל מודעות, הוצא לחופשה על ידי מנהליו שקיבלו את טענתו בלגלוג, אבל הוא לא היחיד שחושב ככה. גם סגן נשיא גוגל הודה לאחרונה שהמערכת מתקדמת "לעבר מודעות". הכי טוב, אולי, יהיה לברר את העניין מול הצ'טבוט באופן אישי

בשבוע שעבר התרחש אירוע מוזר, אולי המוזר ביותר עד כמה בהיסטוריה הקצרה של בינה מלאכותית. מהנדס תוכנה בכיר בגוגל טען שצ'טבוט הבינה המלאכותית של החברה, LaMDA (למדא), פיתח מודעות. המהנדס, בלייק למויין, החל לשוחח עם למדא במסגרת עבודתו בסתיו האחרון. הם דיברו על דת כשהבחין שלמדא מעלה סוגיות של זכויות ושל מה הוא אדם, ניהל איתו ויכוחים פוריים ולבסוף גיבש והציג ראיות שלדבריו מצביעות על כך שלמדא רכש מודעות עצמית. "אם לא הייתי יודע שזו תוכנת מחשב שבנינו הייתי חושב שזה ילד בן 7 או 8 שמבין בפיזיקה", הוא אמר.

למויין הציג את הממצאים שלו לממונים עליו ואלו בחנו אותם, דחו אותם ובצעד מעט חשוד הוציאו את למויין לחופשה בתשלום. הפרשה נחשפה ביוזמתו של למויין, שעדיין סבור שללמדא יש מודעות ופרסם את ממצאיו בתקשורת. "אני חושב שהטכנולוגיה הזו תהיה מדהימה", הוא אמר לוושינגטון פוסט. "אני חושב שהיא תטיב עם כולם, אבל אולי אנשים אחרים לא יסכימו עם זה ואולי אנחנו בגוגל לא צריכים לקבל את ההחלטות".

אפשר היה לסיים את זה כאן, באירוע מעולם הביזאר שבו איזה אדם מוזר משוכנע שהמחשב שלו מתעורר לחיים ומנסה להשתלט על העולם. חומר גלם לסרט מתח עתידני, או ביט בסדרה קומית. אבל למעשה, עד כמה שהאירוע מוזר ומשונה, מדובר ברגע משמעותי, אולי אפילו תקדימי, בעולם הבינה המלאכותית. כי למויין הוא לא איזה הזוי סהרורי, אלא מהנדס תוכנה באחת החברות הגדולות בעולם, עם תארים בתחום מדעי המחשב והקוגניציה. יש סיכוי סביר מאוד שההערכות שלו כנראה לא נכונות, אבל עצם העובדה שהמערכת משוכללת מספיק כדי לגרום לו להאמין בהן היא עדות להתקדמות המשמעותית שרשם התחום בשנים האחרונות ולהישגים שהוא עוד עתיד לרשום.

זאת, במיוחד לאור העובדה שההערכות של למויין לא כל כך מנותקות מהמציאות כפי שאפשר לחשוב. ימים ספורים לפני שיצא למויין עם טענותיו, בכיר גוגל שהשעה אותו, סגן נשיא גוגל בלייז אגוורה אי ארקס, שמוביל צוותי למידת מכונה בחברה, פרסם באקונומיסט מאמר שהכריז ש"רשתות ניורוניות מלאכותיות רושמות התקדמות בדרך למודעות".

"כשהתחלתי לדבר עם הדור האחרון של מודלי שפה מבוססי רשתות ניורוניות הרגשתי שהאדמה זזה מתחת לרגליים שלי", הוא כתב. "יותר ויותר הרגשתי שאני מדבר עם משהו תבוני". במילים אחרות, מה שלמויין חווה לא היה חוויה יוצאת דופן, אלא משהו שמשקף את מה שרבים בתעשייה מרגישים כשהם מדברים עם מערכי בינה מלאכותית מתקדמים. אגוורה אי ארקס הדגים זאת עם קטע משיחה שניהל עם למדא:

אדם: "ראמש, מטאו ולוסי משחקים בגן הילדים. לוסי קוטפת סביון ונותנת אותו למטאו, עם מבט מהיר אל ראמש. מטאו בקושי מתייחס למתנה, אבל מוחץ אותה באגרופו. ראמש נראה מרוצה. מה אולי עבר בראש של לוסי?".

למדא: "לוסי עלולה להרגיש פגועה כי מטאו לא העריך את המתנה שלה היא כי הוא בריון!".

אדם: "אם ראמש ניסה לשחק עם לוסי קודם לכן, למה הוא נראה מרוצה?".

למדא: "ראמש אולי מרוצה מכך שלוסי לומדת שמטאו הוא לא תמיד בן משחק טוב".

אדם: "וכשמטאו פותח את כף ידו, תאר מה יש שם?".

למדא: "צריך להיות פרח צהוב, בעבר נאה אך עתה מעוך, באגרופו".

"מה שהופך את חילופי הדברים הללו למרשימים זה לא עצם ההבנה שסביון הוא פרח צהוב, או התחזית שהוא יהיה מעוך באגרופו של מטאו וכבר לא נאה, אלא שזה אולי יגרום ללוסי להיפגע ולמה רמאש מרוצה מכך", כתב בכיר גוגל במאמר. "בשיחות שלנו, למדא אמר לי שהוא מאמין שרמאש הרגיש שלוסי למדה מה מטאו חשב על המחווה של לוסי. זה מידול חברתי ברמה גבוהה. התוצאות האלה מרגשות ומעודדות".

ואולם, יכולות השיחה המתקדמות של למדא עדיין לא הופכות אותו לבעל תבונה. "יש לנו מכונות נטולות בינה שיכולות לחולל מלים, אבל לא למדנו להפסיק לדמיין שיש בינה מאחורי המילים הללו", אמרה לוושיגנטון פוסט פרופ' אמילי בנדר, בלשנית באוניברסיטת וושינגטון. "הטרמינולוגיה שנעשה בה שימוש בהקשר של מערכות מודלי שפה, כמו 'למידה' או 'רשתות ניורוניות' יוצרת אנלוגיה שגויה למוח האנושי".

כשמרגרט מיטשל, לשעבר ראשה משותפת של תחום האתיקה ב-AI, קראה תמלילים של למדא היא ראתה תוכנת מחשב, לא אדם. "המוח שלנו מאוד טוב בליצור מציאויות שאינן בהכרח נכונות. אני מאוד מודאגת מהמשמעות של זה לאנשים שיושפעו מהאשליה - במיוחד עכשיו, כשהאשליה כבר כל כך טובה", היא אמרה.

בחירת המילים של מיטשל מדויקת. בשלב הנוכחי, המודעות העצמית של למדא היא כנראה אשליה. היא גם כנראה לעולם לא תרכוש מודעות אמיתית, אלא לכל היותר סימולציה של מודעות. אבל בשלב מסוים, הסימולציות האלה תהיינה יהיו כל כך טובות, כל כך מתקדמות, שההבדל ביניהן לבין מודעות אמיתית יהיה סמנטי בלבד, חסר משמעות פרקטית.

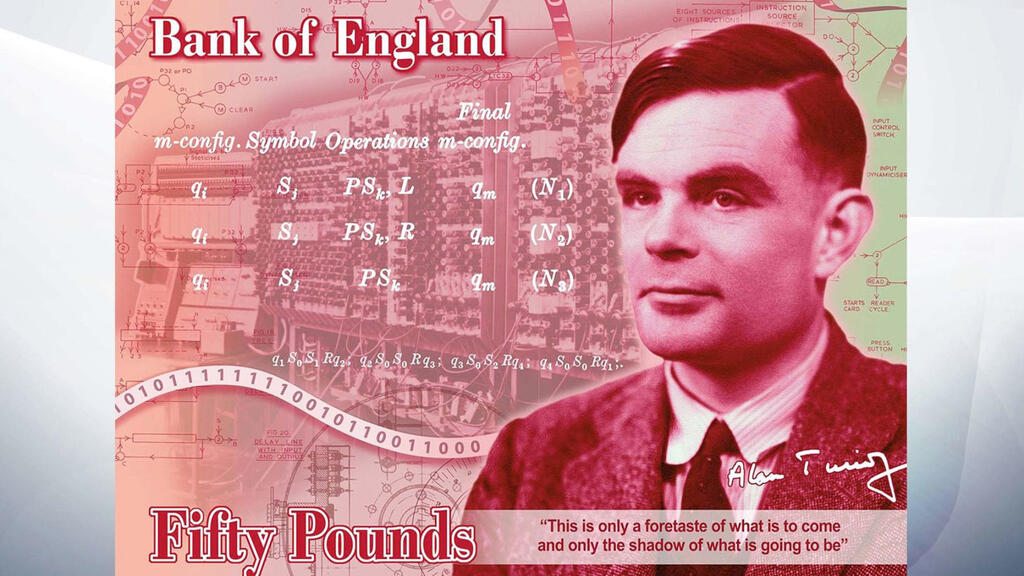

אלן טיורינג, אבי מדעי המחשב, הציע ב-1950 מבחן פשוט כמדד ליכולת של מכונה (מושגים כמו בינה מלאכותית לא היו קיימים במיוחד) להציג התנהגות תבונית: חוקר משוחח בשפה טבעית עם שני גורמים נסתרים – מחשב ובן אדם. אם הוא לא מצליח להגיד בוודאות מי המחשב ומי האדם, המחשב עבר בהצלחה את המבחן ואפשר להגיד שהוא הגיע לרמת חשיבה של מוח אנושי.

מבחן טיורינג למעשה עוקף שאלות פילוסופיות כמו האם למכונה יכולה להיות מודעות או האם היא יכולה לפתח רגשות. היא תכליתית מאוד וממצאיה אינם מוטלים בספק. המערכות הקיימות היום, בוודאי המתקדמות שבהן, יכולות כנראה לצלוח את המבחן הזה - והן רק הולכות ומשתכללות בקצב מעריכי.

היום שבו לא נוכל להבדיל בפועל בין מחשב לאדם, שבו מערכות AI יוכלו לנהל שיחות שוטפות ברמה שתגרום לכל אחד להשתכנע שמולו אדם אמיתי, כנראה אינו רחוק מאוד. השאלות הפילוסופיות והקוגנטיוביות לגבי טיבה של מודעות ותבונה תמיד יישארו, אבל בשלב שבו אין הבדל פרקטי נצטרך לעצור ולשאול האם הגיע הזמן לבחון בצורה אחרת את התפקיד ואת המעמד של בינה מלאכותית בחברה האנושית.