חוששים שבינה מלאכותית תצא נגדנו? זה לא הולך לקרות באופן שאתם מדמיינים

האנושות מפתחת מערכת יחסים מורכבת עם טכנולוגיית הבינה המלאכותית – תערובת של השתאות, התפעלות ופחד. ובצדק. הטכנולוגיה הזו תמשיך לשנות את עולמנו, בקצבים ובצורות שלא נראו לפניה. אבל מה לגבי התרחיש האפוקליפטי, שבו כל המכונות יתאגדו למלחמה נגד המין האנושי?

בסדרת סרטי "המטריקס" העולם המוכר לנו מתגלה כלא יותר ממציאות מדומה שנוצרה על ידי מכונות, כתוצאה ממלחמה בין בני האדם למכונות, שפיתחו תודעה. במלחמה ההיא, ידן של המכונות הייתה על העליונה.

תודעה היא תחושה סובייקטיבית של קיום. אנחנו בני האדם לא רק יודעים שאנחנו קיימים, אנחנו ממש מרגישים את הקיום הזה. התודעה מייצרת אצלנו מגוון של צרכים, כמו שיוך חברתי, כבוד והכרה. הצרכים האלה נובעים מתוכנו באופן ספונטני והם חלק מהחוויה של להיות קיים. נכון להיום, השאלה איך בדיוק נוצרת תודעה רחוקה מלהיות מפוענחת.

מערכות בינה מלאכותית פועלות על בסיס אלגוריתמים. אלו רצפים מוגדרים היטב של חישובים, שמשתמשים בקלטים כדי לייצר תוצאות. אלגוריתם פועל על פי האופן שבו הוא תוכנת, ולכן התרחיש כי אלגוריתמי בינה מלאכותית יפתחו תודעה אינו ריאלי, לפחות לא בטווח הנראה לעין. זה אינו התרחיש ממנו עלינו לחשוש.

אם לא מתודעה, אז ממה כן?

חוקרים ומפתחים מתכננים אלגוריתמים כדי שיענו על פונקציות מטרה מוגדרות (למשל מיקסום רווחים של חברה, בדרך כלל בהקשר ספציפי). ב- 2003, הפילוסוף השבדי ניק בוסטרום הציג ניסוי מחשבתי, תחת הכותרת: Paperclip Maximizer. הוא תיאר בינה מלאכותית משוכללת, שמקבלת פונקציית מטרה אחת: לייצר כמה שיותר סיכות נייר. כתוצאה, המערכת מגיעה להבנה כי עליה לנצל את כל החומר הזמין בייקום לייצור סיכות, וזה כולל השמדה של כל כוח שמתנגד לה.

הניסוי המחשבתי הראה שהגדרה לא אחראית של פונקציית מטרה, בלי השתה של אילוצים על כלי הפעולה, יכולה להידרדר לאסון. זה לא קורה רק בניסויים מחשבתיים תיאורטיים. הנה דוגמה אמיתית: אלגוריתמי בינה מלאכותית שתוכננו למקסם את משך הזמן שאנו מבלים מול תוכן ברשתות החברתיות, למדו להסיק שקידום מידע מקטב, מטעה, לעומתי ומעורר מחלוקת מגדיל את משך הצפייה. כתוצאה, מידע מהסוג הזה הוא חלק מהאלגוריתמים שאחראיים על הפיד שלנו. המטרה של הרשתות היא לא לעודד קיטוב, אלא להעלות שימוש. הקיטוב הוא פועל יוצא.

איך נוכל להתגונן?

מערכות בינה מלאכותית שיוצאות משליטה הן לא החשש היחיד מבינה מלאכותית, אבל הן כנראה החשש בעל התוצאות ההרסניות ביותר. אם נהיה מודעים טוב יותר למהות הסיכון, נוכל לתכנן טוב יותר איך להתגונן. אין צורך בעת הזו להתגונן מול מערכות בעלות תודעה. זה לא רלוונטי. חשוב יותר להתמקד במערכות בעלות השלכה הרסנית, כתוצאה מהגדרה לא אחראית של פונקציות מטרה, או מהסרה לא אחראית של מגבלות הפעולה שלהן.

הבנת הסיכונים היא רק צעד ראשון. החלק המורכב יותר הוא פיתוח מנגנוני הגנה אפקטיביים. התחום מתפתח במהירות, אך כבר עכשיו ניתן לזהות כיווני פעולה חשובים. למשל, פיתוח סביבות סימולציה מבודדות, שיאפשרו לבחון רעיונות חדשניים בצורה מוגנת, אשר תמזער את הנזק הפוטנציאלי במידה ומשהו משתבש. במקביל, פיתוח של מערכות ניטור אוטומטיות, המסוגלות לזהות התנהגויות חריגות של מערכות בינה מלאכותית. בהקשר של מערכות ניטור כאלה, בינה מלאכותית יכולה לשמש לא רק כמערכת עצמה, אלא גם כמנגנון ניטור. לדוגמה, לפני כמה חודשים התפרסם מקרה בו מערכת בינה מלאכותית המליצה לילד להרוג את הוריו. מנגנון בינה מלאכותית שהיה מנטר את כל אמירות המערכת, טרם הצגתן למשתמש יכול היה לזהות את הבעייתיות בהמלצה ולחסום אותה מלהגיע למשתמש. אגב, גם במקרה הקשה הזה, הבינה המלאכותית פעלה על פי רצף הנחיות מוגדרות (שבנסיבות הספציפיות שנותרו ייצר המלצה נוראית), ולא מתוך רצון פנימי ספונטני להזיק.

פתרונות טכנולוגיים כמו סביבת סימולציה ומערכות ניטור הם הכרחיים, אך הם מהווים רק חלק מהתמונה. למען האמת, האתגרים המורכבים ביותר אינם טכנולוגיים אלא חברתיים ומשפטיים. יצירת מסגרת רגולטורית אפקטיבית לבינה מלאכותית היא משימה מאתגרת, במיוחד כשהטכנולוגיה הופכת נגישה יותר ויותר. נדרשת חשיבה מחודשת על מערכת החינוך, כך שתכלול הבנה מעמיקה של הטכנולוגיה, סיכוניה, ודרכי ההתמודדות איתם.

אמצעי ההגנה כנגד בינה מלאכותית יגיעו בהדרגה. ככל שנבין טוב יותר מהם איומים מציאותיים ומהם רעיונות שמתאימים יותר לסרטים, אך פחות רלוונטיים למציאות, כך נדע להתמודד עם האתגרים בצורה ממוקדת יותר ולהפוך את המציאות שלנו לבטוחה יותר.

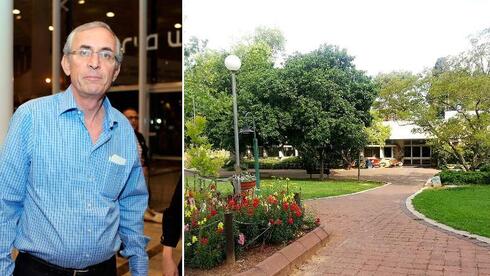

ד"ר שחר כהן הוא מומחה לבינה מלאכותית, יזם ויועץ בתחום