הכל פייק: איך נראים החיים בעולם שבו אפשר לזייף הכל, כולל הצהרות וידיאו של פוליטיקאים וסרטוני פורנו בכיכובכם

פייק ניוז זה החדשות של 2016. פיתוחים טכנולוגיים מתקדמים ומסוכנים בהרבה מאפשרים לזייף היום הכל: מהקלטת שמע שמחקה קול של מכר כדי לדלות מכם מידע, דרך וידיאו של פוליטיקאי שמאיים במלחמה ועד סרטון פורנו שעליו מודבק הפרצוף שלכם. באקלים כזה, או שכל אחד יבחר בגרסת מציאות משלו, או שנפקפק בכל ונהפוך לאדישים. כך או כך זאת סכנה חמורה לדמוקרטיה

בדצמבר 2016 פרסם האתר AWDnews כתבה שבה מצוטט בוגי יעלון, שר הביטחון לשעבר, מזהיר את פקיסטן שלא לשלוח לסוריה כוחות למלחמה בדאעש: "אם פקיסטן תשלח כוחות קרקע לסוריה בכל תואנה שהיא, אנחנו נשמיד אותה בהתקפה גרעינית". אלא שיעלון לא אמר את הדברים. פייק ניוז. ובכל זאת גררה הכתבה תגובה מכיוון שר ההגנה הפקיסטני בכבודו ובעצמו, חוואג'ה אסיף, שצייץ בטוויטר: "שר ההגנה הישראלי מאיים בתגובה גרעינית בהנחה שפקיסטן תשחק תפקיד בסוריה נגד דאעש. ישראל שוכחת שגם פקיסטן היא מדינה גרעינית".

להאזנה לכתבה, הוקלט על ידי הספריה המרכזית לעיוורים ולבעלי לקויות קריאה https://www.clfb.org.il/heb/main/

כל אפיזודת האיומים הזאת חלפה די מהר. משרד הביטחון הישראלי מיהר להבהיר בטוויטר שלא היו דברים מעולם. השר הפקיסטני ספג קיתונות של ביקורת על האצבע הקלה שלו על הטוויטר, וצייץ למחרת הבהרה כי התוכנית הגרעינית של ארצו נועדה רק למטרת הרתעה: "אנחנו רוצים דו־קיום ושלום באזור שלנו ומעבר לו". למבוכת פקיסטן עלתה הפרשה לכותרות בכל העולם, וגם היום אפשר למצוא בטוויטר פקיסטנים שמסתלבטים על אסיף, עכשיו כבר שר החוץ, על הנפילה שלו בפייק ניוז. את הציוץ המקורי הוא מחק.

אבל יותר משהיא פדיחה מצחיקה, הפרשה הזאת מצמררת. מעצמה גרעינית משגרת איומים כלפי ישראל, בגלל פייק ניוז שאפילו לא נוסח טוב וכלל שגיאת כתיב בכותרת. ומה אם היה מדובר בהקלטה מזויפת של בכיר ישראלי משגר איומים לעבר פקיסטן? או בראיון וידיאו מזויף שבו הוא משגר איומים כשהוא עומד ליד מטוס בביקור בבסיס חיל האוויר? איזו תגובה היינו מקבלים אז?

אלה לא שאלות תיאורטיות. במעבדות מחקר ובחברות מסחריות עובדים על טכנולוגיות כאלה במרץ, וכבר אפשר למצוא ניצנים לשימוש שלהן באינטרנט. זה לא חייב לעצור בחדשות מזויפות. לא רחוק היום שבו תגלו כי מי שדיבר איתכם בטלפון בקולו המוכר הוא לא העמית מהעבודה, אלא תוכנה שמחקה אותו באופן מושלם ומנסה לשאוב מכם מידע פרטי. ואולי לא רחוק גם היום שבו לא נדע אם בכלל אפשר להאמין למשהו ממה שאנחנו רואים במסכים. בחודשים האחרונים מתרבים הקולות שמזהירים שפייק ניוז זה החדשות של 2016. כי מה שעומד בפתח, בחסות הטכנולוגיה, גרוע בהרבה. ברוכים הבאים לאפוקליפסת המידע. האינפוקליפסה.

אחד מנביאי האינפוקליפסה הראשונים הוא אביב עובדיה (31), יליד קיבוץ שהיגר עם משפחתו לארצות הברית בגיל 4, סיים תואר שני במדעי המחשב ב־MIT והספיק לחלוף בקצרה באמזון, גוגל ו־Quora, לפני שנהפך ליועץ עצמאי לסטארט־אפים בעמק הסיליקון. באמצע 2016 הוא חווה התפכחות, ונבהל. "זה היה רגע א־הא, שבו הבנתי שהמצב הרבה יותר גרוע ממה שחשבתי", הוא מספר ל"מוסף כלכליסט".

"תמיד התעניינתי באופן שבו מידע מופק ונצרך על ידי אנשים", הוא נזכר. "עקבתי אחרי הידרדרות האקו־סיסטם החדשותי, וניסיתי לחשוב על דרכים שבהן יהיה אפשר לשפר אותו". אבל אז, במאי לפני שנתיים, התחברו לעובדיה כמה תובנות שנתנו לו תחושת דחיפות. אלה היו תובנות על האופן שבו בנויות מערכות כמו פייסבוק, גוגל ויוטיוב, ועל מה קורה כשהן פוגשות את הפסיכולוגיה האנושית, במיוחד כשמחברים אותן למודל העסקי של התקשורת במאה ה־21. "הבנתי שמדובר בלולאת היזון חוזר שיצאה משליטה. האופן שבו תוכן מאיכות נמוכה מקבל עוד ועוד תשומת לב, ליבוי השנאה והפחד — אלה דברים שנעשים גרועים יותר ויותר, ואין שום דבר שיעצור את המירוץ לתחתית". ההתפכחות הזאת גרמה לעובדיה לשנות מיקוד: "העיסוק בזה נהפך ממשהו שאני עושה בזמני החופשי לדבר החשוב ביותר שאני יכול לעשות".

עובדיה הכין מצגת שנושאת את הכותרת "אינפוקליפסה" באותיות לבנות על רקע שחור ומאיים, ויצא איתה לסיבוב פגישות בעמק הסיליקון בניסיון לפקוח את עיניהם של עמיתיו לחזית הטכנולוגיה, כולל אלה שעובדים בפלטפורמות הטכנולוגיות הגדולות, כמו פייסבוק. באחד השקפים הוא מזהיר, למשל, שבסביבה הנוכחית דווקא תוכן מטעה, מקטב ושערורייתי הוא זה שמוביל ליותר קליקים ושיתופים ולכן גם ליותר כסף בצורת הכנסות מפרסום. הפוך ממה שהיינו רוצים.

הימים היו ימי קמפיין הבחירות לנשיאות ארצות הברית, והמסר של עובדיה לא זכה להיענות. "התגובות נעו בין 'אין כאן שום בעיה' לבין 'מאז ומתמיד היתה בעיה עם אינפורמציה שגויה, ואין כאן חידוש. ואפילו אם יש, אין שום דבר שנוכל לעשות בנדון, כי אנחנו רוצים להיות סופר־ניטרליים, וזה עלול לגרום לנו להיראות פחות ניטרליים'. היו גם אנשים שאמרו 'כן, זאת בעיה, אבל אין לי כוח פוליטי לעשות שום דבר לגבי זה בתוך הארגון'".

בשנתיים שחלפו מאז, ובמיוחד בשבועות האחרונים, נהפכו הפייק ניוז והשימוש לרעה בפלטפורמות הטכנולוגיות לנושאים שתופסים את הכותרות ומטלטלים את עמק הסיליקון. עובדיה, כיום הטכנולוג הראשי במרכז לאחריות במדיה חברתית של אוניברסיטת מישיגן, שקם השנה, מעדיף מונחים מדוייקים, כמו דיס־אינפורמציה (יצירת תוכן שגוי בניסיון מכוון להונות) ומיס־אינפורמציה (שיתוף לא מכוון של תוכן שגוי או מטעה). "הבעיות האלה עדיין ענקיות, וצריך להילחם את הקרבות האלה, שלא נלחמו עד כה כמו שצריך. אם פעם היו רק כמה אנשים שמתעסקים בזה בזמנם החופשי וצועקים שהשמים נופלים, לפחות עכשיו כל אחת מחברות הטכנולוגיה בונה צבא קטן כדי להתמודד עם זה. אמנם קצת באיחור, אבל עדיף מאשר לעולם לא".

הבעיה היא שכבר אפשר לזהות את האיומים הבאים. "גם כשאנחנו נלחמים את הקרב הזה, חשוב להבין שיש צבא ממש גדול שמגיע מעבר לפינה, ויש לו כלי נשק משונים ומטורפים שאנחנו לא יודעים איך להתמודד איתם, ועלול להיות קשה הרבה יותר להתגונן מפניהם".

אילו כלי נשק?

"כבר כיום ניתן לעשות לקובצי וידיאו ושמע מניפולציות בדרכים משוכללות שלא היה ניתן לעשות קודם ובמשאבים מינימליים. וידיאו ושמע הרבה יותר משכנעים ואפקטיביים מתמונה ומטקסט. הם מתחברים למוח שלנו טוב יותר. כיום אפשר, באמצעות דגימת קול קטנה של מישהו, לגרום לו להגיד מה שאתה רוצה. למשל, ליצור הקלטה ש'מתעדת' פוליטיקאי שמבצע עסקה מושחתת. ואחריה יהיו גם הקלטות של כל הפוליטיקאים האחרים שמתמודדים מולו, כשהם עושים בדיוק אותו דבר.

"במצב כזה, איך אפשר לדעת מה אמיתי? אפשרות אחת היא לבחור במה שאתה רוצה להאמין בו, כשיש דברים שסותרים זה את זה. האפשרות השנייה היא אדישות. כשאתה לא יכול להבדיל בין מה שאמיתי לבין מה שלא, אתה פשוט מוותר ואומר 'לא משנה, אני פשוט לא אנסה להחליט מה אמיתי ומה לא'. כשמנסים לקיים ככה דמוקרטיה, זה לא עובד".

עובדיה ממשיך ומגלגל תרחישים. למשל, של סרטונים מזויפים בנושאים נפיצים, "כמו הינדי שתוקף מוסלמי או שיעי תוקף סוני. ברמה המקומית זה עלול להוביל לקונפליקט אמיתי. וברמה הגלובלית אפשר ליצור סרטונים של מנהיגים ודיפלומטים שמתבטאים או פועלים באופן שלילי נגד מנהיגים אחרים. זה גם יכול ליצור מתח אמיתי.

"הטכנולוגיות האלה מובילות למוות באלף חתכים לאופן שבו אנחנו מבינים את העולם, לאופן שבו הידע מועבר, לאופנים שבהם אנחנו מקבלים את ההחלטות הפוליטיות שלנו, את החלטות הבריאות שלנו. אם אתה יכול ליצור חיקויים מספיק משכנעים של המציאות, אתה יכול לבצע מניפולציה של דעת הציבור באופן אפקטיבי הרבה יותר. כדאי לחשוב על האיומים האלה ברצינות, ועל העובדה שלא קיים צבא רציני שניצב מולם. אלה שוב רק כמה אנשים שמתריעים בזמנם החופשי. זה לא מצב בריא".

הנה הקלטה שלכם אומרים משהו שמעולם לא אמרתם

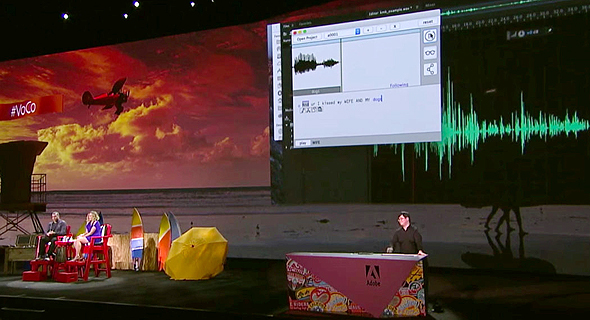

האינפוקליפסה, כאמור, כבר בפתח. לפחות בגרסה ראשונית. בכנס בסוף 2016 הכריזה ענקית התוכנה אדובי, ממציאת פוטושופ, על אב טיפוס לתוכנה חדשה ששמה Voco. "כבר עשינו מהפכה בעריכת תמונות, עכשיו הזמן שנעשה את זה בתחום האודיו", הצהיר אחד המפתחים שהציג את התוכנה. המוצר המהפכני מאפשר לקחת הקלטה של דובר אנושי ולהוסיף לה בהקלדה מילים ומשפטים חדשים, שיישמעו כאילו הדובר המקורי אמר אותם. כל מה שדרוש הוא 20 דקות הקלטה של הדובר, שישמש ל'אימון' המערכת. ההכרזה של אדובי הכתה גלים, אבל בינתיים לא יצא ממנה יותר מדי: עוד אין מוצר כזה על המדפים או בגרסת בטא.

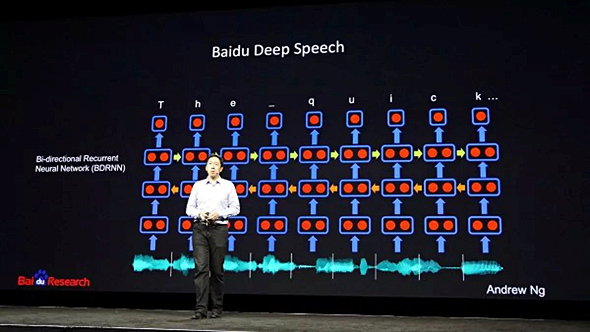

אבל חברות אחרות המשיכו קדימה. למשל Lyrebird, סטארט־אפ קנדי שקרוי על שם הציפור האוסטרלית שיודעת לחקות קולות (בשמה העברי: נִבְלִי הָדוּר), שהמוצר שלו מאפשר ליצור הקלטה מלאכותית על סמך דגימת קול הנמשכת 60 שניות. ואילו באידו, ענקית החיפוש הסינית, הכריזה בתחילת החודש על Deep Voice, תוכנה לשיבוט קול, שאותה אפשר לאמן באמצעות דגימת קול של שניות אחדות בלבד. בהדגמות ששחררה באידו, התוכנה ממירה משפט שאומר דובר עם מבטא בריטי למשפט במבטא אמריקאי, וגם ממירה טקסט לדיבור בקול שמחקה את זה המוקלט בדגימה. בגרסה שמתבססת על דגימה קצרה, זה לא נשמע משכנע. אבל כשמאמנים את המערכת באמצעות מאה דגימות קול, היא כבר נשמעת לא רע בכלל.

עכשיו קחו את התוכנות האלה ושדכו אותן לתוכנה שאותה הציגו בשנה שעברה חוקרים מאוניברסיטת וושינגטון. המערכת שלהם מסוגלת לקחת הקלטה של דובר כלשהו, להדביק אותה לסרטוני וידיאו קיימים שלו, ואז להזיז את השפתיים בסרטון כך שייראה כאילו הוא אומר את המשפט שהדביקו לו. בהדגמה הם בחרו לדובב את אובמה. במחקר דומה מהשנה החולפת יצרו חוקרים מאוקספורד וידיאו מדובב מתמונה של בראד פיט. ואילו חוקרים מאוניברסיטת מינכן, שפיתחו מערכת ששמה Face2Face, בחרו בדונלד טראמפ. המערכת שלהם מסוגלת להשתמש בדמויות המצולמות כמו בובות: החוקרים עושים פרצוף מול המצלמה, והופ! טראמפ עושה את אותו הפרצוף על המרקע.

בינתיים, התחום שמצוי בחזית הטכנולוגיה הוא הפורנו: תוכנה ששמה FakeApp, שאותה פיתח מתכנת אנונימי שהתבסס על קוד פתוח, והחלה להסתובב בתחילת השנה, מאפשרת להשתיל פרצופים של אדם אחד על גוף של אדם אחר בסרטון. לפי הדיווחים, מאז תחילת 2018 כבר הורידו אותה יותר מ־120 אלף פעם. היכולת הטכנולוגית לא מושלמת, אבל היא קיימת. וכבר נוצרה סביבה קהילה של יצרני Deepfakes פורנוגרפיים: סרטונים שמדביקים ראשים של ידוענים (ובעיקר ידועניות) על משתתפים בסרטוני פורנו. שורת אתרים כבר הספיקה לאסור הפצת סרטונים כאלה.

"הכלים החדשים מאפשרים לכל אחד לעשות בקלות דברים שבעבר דרשו יכולות הפקה רציניות וכמויות השקעה כל כך יוצאות דופן עד שאף אחד לא עשה את זה, כי לא היה ברור אם ההשקעה תחזיר את עצמה", אומר עובדיה. "ועכשיו חבורת אנשים באינטרנט יכולים לנסות להרוס את הסדר העולמי בשביל הצחוקים, כי זה כיף. זה כבר קורה. או שאלה יכולים להיות גורמים שמנסים לערער את היציבות באזור כלשהו, כדי לשבש את מאזן הכוחות, ויש אנשים שעושים את זה בשביל הכיף, או כדי לעשות רווחיים או להשיג מטרות פוליטיות. כל האפשרויות האלה על השולחן".

כך תדיחו את ראש העירייה שלכם בכמה צעדים פשוטים

עובדיה אינו היחידי שמזהיר מהעתיד המזויף אליו אנחנו מתקרבים בצעדי ענק. מהצד האחר של האוקיינוס האטלנטי משמיע התרעה ד"ר שחר אבין מאוניברסיטת קיימברידג'. "אנשים צריכים אינפורמציה ומשתמשים בה כדי לקבל החלטות. זה לא חדש", הוא אומר ל"מוסף כלכליסט". "אחרים מפמפמים לעברם מידע מוטה כדי לגרום להם לעשות דברים. גם זה לא חדש". החידוש הוא טכנולוגיות כמו בינה מלאכותית ולמידת מכונה, שמביאות לקפיצת מדרגה. זאת ההתפתחות שאבין ועמיתיו רוצים להזהיר מפניה. הם עושים את זה בדו"ח מיוחד על "שימוש זדוני בבינה מלאכותית", שפורסם בחודש שעבר וכבר עורר לא מעט רעש בתקשורת העולמית. בין שלל האיומים שהדו"ח מפרט, נכלל גם סיכון לתהליך הפוליטי באמצעות הקלטות וסרטונים מזויפים.

אבין (33) התגלגל לקיימברידג' אחרי השירות הצבאי בארץ, עשה שם תואר ראשון במדעים מדויקים ודוקטורט בפילוסופיה של המדעים, ואז, אחרי פסק זמן כמתכנת בגוגל, חזר לפוסט־דוקטורט במכון מחקר חדש שנפתח באוניברסיטה: "המרכז לחקר איומים קיומיים". הוא הוקם על ידי יאן טלין, שהיה אחד היזמים של סקייפ, יחד עם האסטרונום המלכותי של בריטניה פרופ' מרטין ריס והפילוסוף יו פרייס. האיומים הקיומיים שבהם המרכז מתמקד הם כאלה שיש בהם מעורבות אנושית. "זה לא שאנחנו חושבים שאסטרואידים זה לא חשוב, אבל הסיכוי שאסטרואיד ייפול וישמיד את האנושות הוא נמוך. זה משהו שקורה בין פעם בעשרת אלפים שנים לפעם במאה אלף שנה. לעומת זאת הסיכוי למלחמה גרעינית משמעותית גבוה יותר, וכך גם הסיכוי לשינוי אקלים קיצוני".

אבין לוקח את הטכנולוגיות והתרחישים שעובדיה משרטט, ומשלב אותם בתמונה גדולה יותר. הוא מדבר, למשל, על שני שלבים: קודם כל, איסוף תובנות באמצעות ניתוחים סטטיסטיים מתקדמים על התנהגות הגולשים. "בשלב השני איסוף התובנות מאפשר התערבות. אם אני יכול לשים קובץ וידיאו או שמע מזויף, בין שזה בפוסט פייסבוק, ציוץ, מייל או הודעת ווטסאפ של מישהו, אז אני יכול ללמוד הרבה על מה מניע גולשים, ואילו החלטות הם מקבלים בתגובה.

"קח למשל את תושבי ראשון לציון. לי אין מושג כרגע איזה סרטון אני יכול להנדס כדי לגרום להם לצאת לרחובות ולהחליט שלוקחים את ראש העירייה וזורקים אותו לים. אני לא יודע אם יש סרטון כזה. ואם אני צריך לשבת ולהכין את הסרטונים האלה בעצמי, ולשכור את הקופירייטרים הכי טובים, יש סיכוי קלוש שאצליח. אבל נניח שאני מסוגל להזריק סרטונים שהאלגוריתם מייצר עבורי, יום־יום, לעשרת אלפים תושבי ראשון לציון ולראות איך הם מגיבים. פעם בכמה זמן תצא תוצאה שלא צפיתי מראש, שבאמת תוציא אותם לרחובות. ואז, אם אבנה כמה כאלה יחד, אולי אצליח להוציא רבים מהם לרחובות ולזרוק את ראש העירייה לים. וכנראה לא מגיע לו, הוא כנראה בן אדם נחמד".

איפה הטכנולוגיות החדשות עומדות ביחס למה שכבר ראינו ב־2016 סביב הברקזיט, טראמפ וההתערבות הרוסית בבחירות בארצות הברית?

"מה שקיימברידג' אנליטיקה (חברת הייעוץ שעבדה עם קמפיין טראמפ ועומדת היום במרכז שערוריית דליפת פרטי המשתמשים של פייסבוק, א"פ) עשתה זה לכתוב פוסטים, שכמעט בוודאות נכתבו על ידי אנשים, להראות אותם בפידים של משתמשים, ולראות על מה מקליקים. עד כמה אנחנו מתקרבים לשלב שבו מחשבים יכתבו את הפוסטים האלה? בציוצים שפרסם פרנסואה שולה (אחד המהנדסים הבכירים של גוגל, א"פ) הוא מניח שפייסבוק עושה את זה כבר היום. כנראה זה גם קורה בפרסום. היו חוקרים סינים שהראו ב־2017 איך אפשר לשנות ככה נוסחי פרסומות כדי לראות מה גורם לאנשים להקליק עליהן יותר. המעבר משינוי טקסט לשינוי תמונה, אודיו או וידיאו, רחוק קצת יותר. זה דורש יותר כוח חישוב והרבה דאטה, אבל זה כבר עניין של שינויים מצטברים בטכנולוגיה. כל עוד זה מעניין אנשים, זה הולך להיות נגיש, אפילו סופר נגיש, בעתיד הקרוב.

"יש חברות שרואות במניפולציות האלה פוטנציאל לרווח. הרי כמעט כל הדברים האלה הם רב־שימושיים. תבוא Lyrebird ותגיד שהיא יכולה ליצור אודיו שלם מהקלטה קצרה, במקום הקריינים יקליטו 'הרכבת תצא מרציף כזה וכזה עוד כך וכך שעות' בשלל וריאציות. זה מקרה שימוש לגיטימי שחוסך כסף. אבל יש גם מי שירצו לשגר לך שיחת טלפון ממישהו שאתה חושב שהוא חבר שלך, אבל זה בעצם בוט".

כך גויסו 100 אלף איש להפיץ שקרים ל־2 מיליארד איש

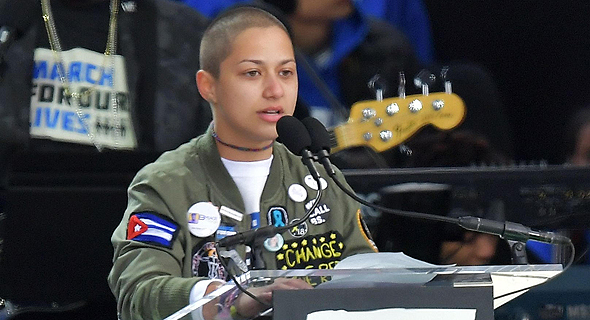

לפני שמדברים על פתרונות לבעיות שאורבות בעתיד הקרוב, צריך להתעכב על עובדה מטרידה: גם הבעיות המוכרות טרם נפתרו. פייק ניוז ברשתות החברתיות, למשל, הוא לא רק סיפור משלהי 2016, שהיה ונגמר. זה עדיין קורה. כך היה אחרי מסע הירי שהותיר 17 תלמידים מתים בתיכון בפארקלנד, פלורידה, בחודש שעבר. הטרגדיה היתה אות פתיחה לדיון לאומי על כלי נשק בארצות הברית, אבל גם אות להסתערות של בוטים רוסיים, חשבונות מזויפים שסייעו בין היתר להפיץ תיאוריות קונספירציה על כך שהירי היה מבוים, או שחלק מהניצולים הם למעשה שחקנים.

למה קשה כל כך לרשתות החברתיות להתמודד עם בוטים שמשתמשים בהן להפצת מידע שגוי? בין היתר מפני שהן התעוררו באיחור. כך מסביר ג'ונתן מורגן, מנכ"ל New Knowledge, סטארט־אפ מאוסטין, טקסס, שעוזר לחברות להתמודד עם מתקפות ברשתות חברתיות, ומייסד Data for Democracy, ארגון התנדבות שמאגד אלפי אנשי טכנולוגיה בעולם. ב־2015 נמנה מורגן (35) עם מחבריו של מחקר מטעם מכון ברוקינגס בוושינגטון, שסייע למשרד החוץ האמריקאי להבין איך להתמודד עם הפעילות של דאעש ברשת. "במקום בתוכן, התמקדתי במכניקה של הפעילות. איך אנשי דאעש היו מסוגלים, עם מספר חשבונות קטן יחסית ותקציב קטן יחסית, להגיע לכזו השפעה אדירה על המדיה החברתית ודרכה גם על תקשורת המיינסטרים. בסופו של דבר, זה היה ההיבט המדאיג.

"בסוף האביב ותחילת הקיץ של 2016, התחלנו לראות את מה שבהתחלה חשבנו שהוא קומץ אנשי ימין קיצוני אמריקאים, שנראו היפר־אקטיביים אונליין, היו עקביים להדהים במסר שלהם, והדהדו אחד את השני. חשבנו שאם זה מה שקורה, יש לנו בעיה אמיתית בארצות הברית. אבל אז שמנו לב שדפוס הפעילות שראינו במדיה חברתית אחת עבר לקהילות שונות בפלטפורמות חברתיות אחרות באותו זמן, והבנו שלא מדובר בפעילות אורגנית. זו לא קהילה שעוברת רדיקליזציה. זה נראה יותר כאילו מישהו עם אג'נדה מסוימת דוחף אותה במגוון מקומות במרמה. וזה כנראה גורם מאד מתוחכם, כמו מדינה".

לפני שנה, כשצמרת פייסבוק עדיין התייחסה בביטול לאפשרות שרוסיה השפיעה על הבחירות באמצעות פייסבוק, פרסם מורגן דו"ח המתעד קמפיין השפעה רוסי נרחב בפייסבוק, בטוויטר ובתגובות לכתבות באתר הימני ברייטבארט. "חלק מהסיבה שנדרש לפלטפורמות המדיה החברתית זמן רב כל כך להכיר בבעיה היא שזה היה בקנה מידה קטן מאוד יחסית. הבעיה באה לידי ביטוי בכיסים קטנים של קהילות אונליין: את הפעילות המניפולטיבית המתואמת היה אפשר לראות במקומות שבהם יש בסך הכל 100 אלף איש או מיליון איש. והמטרה היתה לבצע מניפולציה עליהם ולהפוך אותם ל'נשאים' לגיטימיים של המסר. עבור פלטפורמה ענקית כמו פייסבוק, 100 אלף איש זה אחוז כה קטן, שאני חושב שהם ירגישו טוב לגביו. הם נהגו לחשוב על זה כמו ספאם — אם יש 100 אלף חשבונות ספאם על פלטפורמה של 2 מיליארד איש, זה אומר שהצלחת לתפוס את רוב הספאם".

אפשר להסתכל על זה בהבנה. ומצד אחר, הנה אנחנו אחרי הירי בבית הספר בפארקלנד, ועדיין יש בוטים רוסיים שעושים את אותם הדברים, וליוטיוב ופייסבוק קשה מאוד לשלוט בזה.

"זה נכון. רק בחצי השנה האחרונה התחילו ענקיות הטכנולוגיה להתייחס לבעיה ברצינות. אבל הן מפגרות שנתיים מאחורי היריב שלהן, שכבר חושב על דרכים חדשות לנצל לרעה את הפלטפורמות שלהן ועל דרכים חדשות לבצע מניפולציה ליוזרים שלהן".

איך מנצחים את האינפוקליפסה?

אז מה אפשר לעשות? מורגן מציע פתרונות שיאפשרו למשתמשים להבין טוב יותר מה הם רואים: למשל, להתריע בפניהם כשהם צופים במסר שאותו מריצה במקביל קבוצת חשבונות. גם עובדיה מתאר פתרונות טכנולוגיים, כמו מנגנוני חתימה שיוודאו אותנטיות של הקלטות וצילומים, אבל הוא מדגיש שיש צורך במוסדות חדשים, כמו קוד אתי לאנשי טכנולוגיה, או גופים במימון ממשלתי שייעצו לסטארט־אפים על השפעות שליליות אפשריות של פיתוחיהם. "אנחנו צריכים להתבייש בעצמנו כחברה על כך שמוסד כזה עדיין לא קיים".

אבין סבור שכדי להגיע לפתרון, "קודם כל אנשי מדיניות צריכים לדבר עם טכנולוגים כדי להבין שיש פה בעיה, ויפה שעה אחת קודם. אחר כך הטכנולוגים צריכים להכיר בעובדה שיכולות להיות השפעות שליליות לעבודה שלהם. הם לא יכולים להרים ידיים ולהגיד 'לא ידענו, אנחנו רק טכנולוגים'. אנחנו צריכים לשאוף לעתיד שבו מפתחים יוכלו גם להגיד 'אנחנו חושבים להריץ פרויקט, אבל בעצם לא נריץ אותו או שנריץ אותו אחרת, בגלל סיכון לשימוש זדוני'. זה תהליך לא פשוט, שאנחנו רוצים שיקרה. אנחנו מנסים לדבר על זה בדיונים בכנסים, בהרצאות בחברות הטכנולוגיה ובשיחות עם אנשים שמגבשים מדיניות וחוקים".

אתה אופטימי?

"כן, עם הסתייגות אחת גדולה. בסופו של יום, שחקניות כמו גוגל ופייסבוק מלאות באנשים שרוצים לעשות טוב, מושפעים מאוד מלחץ ציבורי ויכולים לעשות משהו בנדון. אבל זה גם אומר שאם אתה עצמך לא לקוח של גוגל או של פייסבוק, כי אתה בסין, אתיופיה או תימן, אז היכולת שלך לגשת להגנות שהן יספקו היא מאוד מוגבלת. שוב תיווצר מציאות שבה אנשים בעולם הראשון יהיו מוגנים יותר מאנשים במדינות עולם שלישי. ופה צריך פילנתרופים ואקדמאים שיהיו מוכנים לומר 'לא, זאת בעיה של כולם'".