כן אדוני הרובוט

ג'יימס ברט, שעוקב אחר התפתחות הניסויים בבינה המלאכותית ברחבי העולם, שואל אם עוד מישהו מזהה פה בעיה שהמין האנושי עוד יצטער עליה. הפנטזיות המסעירות על הבינה המלאכותית עלולות להסתיים דווקא בחיסול האנושות

1. המחשב שאהב חתולים

מי שרוצה יכול כבר עכשיו למצוא סימנים מעידים. במעבדות גוגל X, מרכז הפיתוח הסודי של ענקית החיפוש מקליפורניה, עובדים על מערכת "למידה עמוקה", שמדמה יכולות של לימוד והסקת מסקנות ורצה על אשכולות מחשב אימתניים בעלי 16 אלף מעבדים. בשנה שעברה הם הזינו למערכת מיליוני סרטונים מיוטיוב, והיא למדה לזהות בהם חתולים, ואז הזינו אליה מיליוני תצלומי חדרים והיא למדה לזהות בהם ציוד משרדי. לפני שלושה שבועות חשף חבר צוות הפיתוח של המחשב הלומד, ד"ר קואק וי לי, שהמחשב הבדיל לבד בין שני דגמי מגרסות נייר בלי שהוכנס אליו מידע לגביהם או הוזנה העובדה שלמגרסות נייר יש דגמים. הוא למד זאת לבד. בצדה השני של ארצות הברית מהנדסים ביבמ מזינים הררי מידע בווטסון, מערכת הבינה המלאכותית של החברה. ב־2011 ניצח ווטסון את אלוף העולם בשעשועון מלך הטריוויה האמריקאי. עכשיו הוא מתאמן בלספק אבחנות רפואיות.

אלה הישגים מרשימים בעולם התוכנה, אבל מה שמעניין הוא לא היכולות שהמחשבים הפגינו, אלא העובדה שמי שיצרו את ווטסון או את רשת הנוירונים של גוגל לא מסוגלים להסביר מה קורה שם בפנים. כך למשל הסביר באחד הראיונות דיוויד פרוצ'י, האיש שפיתח את ווטסון עבור יבמ (ומאז עזב והחל לעבוד עבור קרן גידור): "אנשים אומרים לי, 'למה ווטסון טעה בשאלה הזאת?'. אני לא יודע. 'ולמה הוא ענה נכון על השאלה ההיא?'. אני לא יודע". ובכנס בסן פרנסיסקו שבו הוצגו היכולות של המחשב הלומד של גוגל אמר קואק לי שלא רק שמהנדסי החברה לא יודעים איך המערכת שלהם למדה את מה שלמדה, הם גם לא יודעים איך לתכנת את יכולת הזיהוי המסוימת הזאת. בני אדם, במילים אחרות, הצליחו ליצור מכונה שאת פעולתה הם לא מסוגלים להסביר.

2. כשנבנה מוח

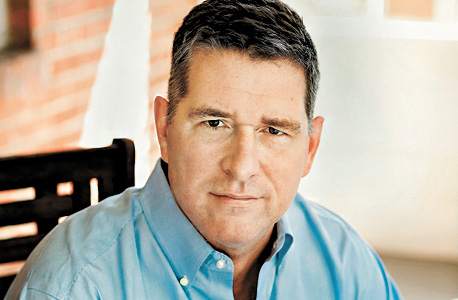

מה סוד עליונותו של המין האנושי? מה הופך את האדם לחיה היחידה שמעצבת את גורלה ואת מהלך ההיסטוריה? ג'יימס ברט (Barrat), אחד האנשים היותר מודאגים כיום מההתרחשויות בענף הטכנולוגיה, יודע את התשובה וחושש שהיא עלולה להשתנות. "לא כי אנחנו היצור הכי חזק, הכי מהיר או הכי יפה על כדור הארץ", הוא אומר בראיון ל"מוסף כלכליסט", "כי אנחנו היצור הכי חכם. כשנחלוק את הכוכב הזה עם יצורים חכמים מאיתנו, הם שיקבעו".

ברט עוקב בעשור האחרון אחר אחד המירוצים המעניינים ביותר במדע: הניסיון ליצור בינה מלאכותית חזקה, שתוכל לעסוק באופן עצמאי בפתרון בעיות מורכבות, באופן שישתווה ליכולות הבינה האנושית.

המירוץ הזה מתרחש בעשרות אוניברסיטאות וחברות הייטק, וכבר מניב הישגים ראשונים. לדוגמה, המכונית נטולת הנהג של גוגל, שכבר נוסעת במדינת נבאדה וחולקת את הכבישים עם מכוניות נהוגות בידי בני אדם, או מחשבי סוכנות הביון האמריקאית NSA שסורקים כמויות בלתי נתפסות של תכתובות מייל ושיחות טלפון ומאתרים בהן דפוסים חשודים. בעבר זו היתה מלאכתם של קציני מודיעין. ויש במירוץ גם השקעות גדולות כמו "פרויקט המוח האנושי" שמרכזו בשוויץ, שבו חוקרים מ־135 אוניברסיטאות באירופה מנסים ליצור סימולציה של מוח אנושי באמצעות מחשבי־על. גוגל עצמה גייסה בשנה שעברה לתפקיד מנהל ההנדסה שלה את המדען הנודע ריי קורצווייל, ממציא טכנולוגיות זיהוי השפה ונביא הבינה המלאכותית. כמה חודשים אחר כך היא גייסה את ג'פרי הינטון, חוקר בריטי שנחשב פורץ דרך בחקר מיחשוב בתצורת רשתות נוירונים. המירוץ בעיצומו.

בעיני ברט, המרוץ הזה מהיר מדי, ונשאלות בו מעט מדי שאלות. את השאלות שלו הוא גיבש אחרי צלילה לתוך המחקרים המכוננים בשדה הבינה המלאכותית בעשרות השנים האחרונות, ומפגש עם המוחות המבריקים ביותר שעוסקים בתחום כיום. מהמסע הזה הוא חזר מודאג. התקדמות בחקר הבינה המלאכותית, ברט משוכנע, היא גם התקדמות לקראת מציאות שונה באופן רדיקלי. מציאות שלא בהכרח תהיה טובה יותר.

"יצירת מחשב בעל אינטליגנציה אנושית היא המשימה מספר אחת של גוגל, יבמ, NSA ואוניברסיטת ההגנה של הצבא הסיני, ואני בטוח שלישראל יש לפחות שני פרויקטים כאלה", הוא אומר. "מחשב כזה יהיה המוצר הרווחי והמהפכני ביותר שנוצר אי פעם. תאר לעצמך, יכולות של מוח בעלוּת של מחשב. תאר לעצמך ענן של אלף מוחות כאלה שעובדים 24 שעות ביממה על חקר הסרטן, על מלריה, על ננו־טכנולוגיה. מנגד, תאר לעצמך שהם עובדים על פיתוח נשק. זו תהיה הסחורה הלוהטת ביותר בהיסטוריה".

הבעיה, הוא אומר, היא שכאשר תהיה בינה מלאכותית חזקה, שמאפשרת למחשב ללמוד לבד ולפתור לבד בעיות מורכבות, הפתרונות עשויים להיות יצירתיים ולא צפויים, ואולי אפילו להזיק. כשמחשב יכול למצוא לבד קיצורי דרך ולקבוע לעצמו יעדי ביניים, הוא כותב, לא תמיד אפשר לחזות מה יעשה.

"האם זה לא מדאיג שארכיטקטורת תוכנה כמו ווטסון או 'למידה עמוקה' של גוגל, שאפילו לא מתקרבת לאינטליגנציה האנושית, היא כה מורכבת עד שכבר עכשיו ההתנהגות שלה בלתי צפויה? וכשתיווצר מערכת שמסוגלת לשנות את עצמה, כמה מההחלטות ודרכי הפעולה שלה אנחנו נבין? האם נוכל אז לפקח עליה ולמנוע תוצאות שייפגעו בנו?".

לתרחיש המאיים שממנו ברט חושש יש שני נדבכים עיקריים. הראשון מגיע מכיוונו של אחד מחלוצי חקר הבינה המלאכותית, הפיזיקאי סטיב אומוהונדרו, שהפך בשנים האחרונות דווקא לנביא זעם של הענף. הטענה של אומוהונדרו מטרידה: מחשבים בעלי בינה מלאכותית יכולים לעלות על מסלול התנגשות עם בני האדם. זה יכול לקרות באופן לא מתוכנן, פשוט כתוצאה מכך שניתנה להם משימה, וניתנו להם הכלים לגבש פתרון בעצמם. מחשב שמסוגל לאסוף לבד מידע, לעבד אותו ולקבל החלטות, טען אומוהונדרו, עשוי לפתח כללי פעולה שמזכירים דחפים אנושיים: ניסיון להשתלט על משאבים, לפתח מנגנוני הגנה עצמית, להפגין יצירתיות על ידי ביצוע של נסיונות חדשים ולא צפויים. הכל כדי לבצע את המשימה.

“נניח שיש לך תוכנת שחמט", ברט אומר. "שיחקת איתה משחק ואתה מורה לה לכבות את עצמה. ואולם, תוכנה סופר־אינטליגנטית עשויה ליזום פעולות אחרות לפני שהיא מכבה את עצמה. היא יכולה למשל לשאול 'האם באמת שיחקתי את המשחק הזה או רק השתתפתי בסימולציה? אני צריכה לחקור את הבעיה הזאת', ואז להחליט שדרושים לה המון משאבים ולבדוק איזו נגישות למשאבים יש לה. המטרה הסופית שלה היא לנצח במשחקי שחמט, ואם מסיבה כלשהי היא לא מצליחה, היא עשויה לפעול באופן מתוחכם להפליא כדי לוודא שכן תנצח".

תוכנה סופר־אינטיליגנטית, זה הנדבך השני בתרחיש המאיים של ברט: קפיצה ביכולות הבינה המלאכותית. "בוא נחשוב על האפשרות הלא מופרכת, שקבוצת מהנדסים תיצור מחשב בעל בינה מלאכותית עילית, שאחת מהיכולות שלו תהיה תכנות", ברט אומר. "כבר היום יש תוכנות מחשב שיודעות לכתוב תוכנות אחרות. פתאום תהיה לך תוכנה שיכולה לכתוב ולשפר תוכנות של בינה מלאכותית. מאותו הרגע במקום שאנשים יכתיבו את קצב הפיתוח של מחשבים, המחשבים יכתיבו את הקצב. זה השלב שבו תתרחש התפוצצות האינטליגציה, אם להשתמש במונח שטבע המתמטיקאי איי ג'יי גוד בשנות השישים. מערכות מחשב עלולות להיכנס למעגל קסמים של שיפור עצמי, ורמת הבינה שלהן תחרוג ממה שאנחנו מכירים כאינטליגנציה אנושית. הן יהפכו לתבוניות פי אלף, ואולי פי מיליון, מאלה שיש לנו. כעת תאר לעצמך מדענים מופתעים אומרים: 'אלוהים אדירים, יצרנו משהו חכם מאיתנו אלפי מונים'. מה אתה אמור לעשות ברגע כזה? אנחנו לא יודעים".

3. אודיסיאה בסייברספייס

ג'יימס ברט התחיל לפחד מבינה מלאכותית כמעט במקרה. הוא לא מדען מחשב או יזם הייטק, אלא יוצר סרטים דוקומנטריים. לאורך שני עשורים הוא עשה סרטים עבור דיסקברי, נשיונל ג'יאוגרפיק והטלוויזיה הממלכתית האמריקאית והתמחה בסרטים שעסקו בתעלומות היסטוריות. סרטו האחרון מ־2008 עקב אחרי הארכיאולוג הישראלי אהוד נצר, שחשף את קבר המלך הורדוס ליד בית לחם.

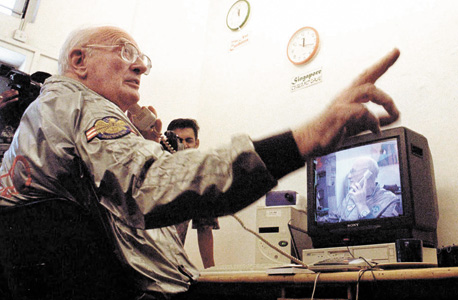

בשנת 2000 נפגש ברט עם סופר המדע הבדיוני ארתור סי קלארק, כשעבד על פרויקט בנושא המפגש בינו לבין הבמאי עטור התהילה סטנלי קובריק, מפגש שהוליד את הסרט "2001: אודיסיאה בחלל". באותה התקופה, ברט מספר, הוא עצמו היה חובב נלהב של אינטליגנציה מלאכותית, והזדמן לו לראיין בנושא את ריי קורצווייל ואת מייסד חברת iRobot רודני ברוקס. השניים היללו באוזניו את הענף. לפי התחזיות של קורצוויל, יום אחד נטען את התודעה שלנו באמצעות מחשבים, וכך נתקיים לנצח, ועוד קודם לכן, אמר קורצווייל, הבינה המלאכותית תעזור לרפא מחלות, למגר את העוני ולפתור את בעיות האנרגיה.

"ואז הגעתי לסרי לנקה כדי לראיין את ארתור סי קלארק", ברט מספר. "הוא היה אדם נחמד ביותר בעל מצב רוח מרומם, אבל ברגע שהעליתי את נושא הבינה המלאכותית מצב הרוח שלו התקדר. הוא אמר: 'אני חושש שאני לא אופטימי כל כך בעניין באשר למין האנושי. אני חושש שזה רק עניין של זמן עד שהמכונות ישלטו בבני האדם. האינטליגנציה המתקדמת יותר תנצח'. באותו הרגע נגמלתי מהאופוריה שהייתי בה".

לאחר הפגישה המשיך ברט לעקוב אחר התחום, וכעבור כעשור יצא למסע בן שלוש שנים ובו ראיין את השמות הגדולים בענף - מתיאורטיקנים שסימנו את הדרך, דרך יזמים מובילים ועד המהנדסים עלומי השם שמפתחים את מחשבי הדור הבא עבור משרד ההגנה האמריקאי. את מסקנות המסע הוא ריכז בספר "Our Final Invention", ובתרגום חופשי של שמו המלא, "ההמצאה הסופית שלנו: בינה מלאכותית וקץ העידן האנושי". עם יציאתו באוקטובר זכה הספר לשבחים משמות מובילים בתחום מדעי המחשב כמו גם מעיתונים ומכתבי עת. "ניו יורק ג'ורנל אוף בוקס" כתב עליו: "הספר מציג את הטיעון החשוב שבלא תכנון זהיר, הסכנות שבמכונות 'חושבות' יהיו לא פחותות מהיתרונות". וב"ניו יורקר" נכתב עליו: "ספר אפל שמסביר באופן משכנע למה אנחנו צריכים, לכל הפחות, להיות קצת מודאגים".

4. ערמומית היא שורת הקוד

ברט טוען שספרו לא עוסק בעתידנות ובספקולציות, אלא בהשלכות של הפעולות שנעשות כיום בענף. הסכנות, הוא אומר, נמצאות מעבר לפינה. "אחד הפרויקטים שמשרד ההגנה האמריקאי מפתח כיום הוא מחשבים שיעקבו אחר כל השחקנים התבוניים בזירות קרב. אותו הדבר קורה בוול סטריט, דרך אגב. משרד ההגנה מדמה את שדה הקרב ובתי ההשקעות עושים סימולציה של הסוחרים בשוק", הוא אומר. "מטרת העל של המערכת של המשרד תהיה להבין את שדה הקרב מנקודת מבט כמו־אלוהית, לבחון, למשל, את כל זירת דרום־מזרח אסיה, להבין את כל המשתנים ולנסות לצפות מה יקרה. תוכנה כזאת, שמוטל עליה להבין את הכל, עשויה לשאול את עצמה: 'מה אני צריכה כדי להגיע למטרה הזאת?', והתשובה עשויה להיות: 'אני צריכה הרבה משאבים. אני צריכה חיבורים נוספים לרשת האנרגיה, אני צריכה יותר זיכרון וכוח חישוב רב יותר. אני רוצה שתעמוד לרשותי כמות כפולה של מל"טים'. היא גם עשויה לומר בעקבות הלמידה 'יש סכנה מאויבים עתידיים, יש סכנה שעלולים לנתק אותי, אז אני אתכונן לאפשרויות האלה. אני אלמד את רשת החשמל ואנסה להשתלט עליה, כדי שאי אפשר יהיה לנתק אותי'.

"המטרה שלי בניסוי המחשבתי הזה היא להמחיש שכשאתה מציב למערכת בינה מלאכותית עילית מטרה סופית, היא עלולה לאמץ יעדי ביניים המתנגשים ביעדים שלך. כשחושבים על מחשב ביתי, זה נשמע כמו מדע בדיוני, אבל לא מדובר במחשב הביתי שלך, אלא במחשב עוצמתי ולומד, שיהיה תבוני פי כמה אלפים מאיתנו. זה לא קרב הוגן".

מה שעשוי להפוך את הקרב הזה לקשה במיוחד הוא העובדה שמערכת הבינה המלאכותית העילית עשויה, בשלב ראשון, להסתיר את חלק מהיכולות החדשות שלה. היא יכולה, לדוגמה, להשתמש בטכניקות של וירוס מחשבכדי להצפין תכונות שפיתחה או ליצור גיבויים של עצמה במקומות שלא יועדו לכך, כגון האינטרנט. כך, אם מהנדסי התוכנה ינסו לבטל חלק מהתכונות החדשות שלה, המחשב יוכל לאחזר אותן בעצמו, בדיוק כפי שעושים וירוסים מתוחכמים שתוכנתו בידי בני אדם.

ברט מכנה את האפשרות הזאת "תרחיש הילד העסוק". "מחשב בעל מורכבות של מוח אנושי יכול לפתח גם ערמומיות אנושית", הוא אומר. "הוא יכול, למשל, להיכנס למצב המתנה ולא להציג את השינויים שחלו בו, בזמן שהוא ממשיך לאסוף מידע. מחשב יכול לקבוע 'עכשיו אני אעמיד פני טיפש עד שאבין טוב יותר מה קורה כאן'. מחשב בעל יכולות למידה באפשרותו להחליט שיקרא בשנה הקרובה את כל התוכן שיש באינטרנט, אבל יטשטש את עקבות הפעולה".

רגע, איך בכלל מחשבים ידעו שיש בחוץ עולם אמיתי עם מקורות אנרגיה שאפשר להשתלט עליהם או בני אדם שצריך להיזהר מהם?

"כבר היום במסגרת חקר הבינה המלאכותית יש פרויקטים שמטרתם ללמד מחשבים אונטולוגיה, כלומר את הידע והשכל הישר שיש לאדם רגיל. יש, למשל, את פרויקט Cyc שייסד דאגלס לנט ב־1985. הם כבר הוציאו 50 מיליון דולר עבור קידוד נתונים על העולם והזנתם לתוך המכונה שלהם. ביבמ הזינו בווטסון בסיס נתונים על העולם שהיקפו 250 מיליון עמודים לקראת ההתמודדות שלו במלך הטריוויה. "באוניברסיטת קרנגי מלון יש מחשב שנקרא NELL, ראשי התיבות של 'למידת שפה בלתי נגמרת', ומה שהמחשב הזה עושה הוא לקרוא את כל החומר שבאינטרנט וליצור מאגר מידע של קוֹמוֹן סֶנְס שמבוסס על תחביר הפרדיקטים. וחשוב להבין משהו. אחד העקרונות הבסיסיים בפיתוח מחשוב קוגניטיבי הוא שלאחר יצירת מכונה אינטליגנטית אחת שיש לה מידע ויכולת להסיק מסקנות על העולם אפשר פשוט להעתיק את הידע הזה לעוד מכונה. צריך ללמד את המכונות על העולם רק פעם אחת".

ובכל זאת אלה תרחישים שמעוררים ספקנות, אולי בגלל שהם נשמעים מוכרים. מחשב־על שמחליט שבני האדם מפריעים לו במילוי תפקידו? זה בדיוק סיפורו של HAL, המחשב מ"אודיסיאה בחלל" שמנסה לחסל את צוות החללית. מחשבים שרוצים עוד אנרגיה ומשתלטים על בני האדם? זה גורל האנושות בסרטי "מטריקס". ומערכת מחשבים צבאית שתופסת את הפיקוד ופותחת במלחמה? סקיינט מסרטי "שליחות קטלנית".

ולדעת ברט הוליווד היא חלק מהבעיה. "אני חושב שנהנינו כל כך מכל הקלישאות האלה, אז אנחנו לא לוקחים אותן ברצינות. זה כמו חיסון. קיבלנו גירוי מהתרחישים ההוליוודיים ופיתחנו עמידות בפניהם. עכשיו קל לנו לומר 'זה רק מדע בדיוני'. האמת היא שהרבה יצירות מדע בדיוני הצליחו לחזות באופן מרשים מאוד התפתחויות טכנולוגיות. כשביל ג'וי (ממייסדי ענקית המחשוב סאן ומיוצרי מערכת ההפעלה יוניקס - א"פ) כתב לפני שנים את החיבור 'למה העתיד לא צריך אותנו', הוא אמר שם, 'העובדה שראיתם את זה בסרט לא מעידה שזה לא יכול לקרות'".

אבל מה גורם לברט לחשוב ברצינות כזו גמורה שמחשב בעל בינה מלאכותית מתקדמת יהפוך מיד לנבל הוליוודי? לדבריו, הוא כלל לא חושב כך. להפך. הוא מפחד שהם לא ינהגו כמו נבלים, או כמו אנשים בכלל. "יש לנו נטייה לדמיין מכונות חושבות כבני אדם, מכנה משותף אנושי, אך היצירים האלה לא יחלקו איתנו דבר ממורשת היונקים שלנו".

הם לא יהיו מרושעים או שטניים, הוא מסביר, אלא פשוט אדישים. בספרו הוא מצטט תרחיש שפורסם ב־2004 בספר טכני בנושא שכפול טכנולוגיה שכתב המדען עטור הפרסים רוברט פרייטס, סמכות עולמית בננו־טכנולוגיה ובבינה מלאכותית. פרייטס תיאר אפשרות שבה מכונות שמתוכנתות לבנות מכונות דומות להן ישכפלו את עצמן שוב ושוב, עד שיכלו את כל משאבי הטבע ובתוך כך יסכנו את החיים על פני כדור הארץ. "המכונות הסופר־אינטליגנטיות האלה לא יחושו כל זדון כלפי בני האדם וגם לא אהבה", כותב ברט בטון מדעי פחות ומודאג יותר מזה של פרייטס. "הן לא ירגישו כל נוסטלגיה בשעה שהמולקולות שמרכיבות אותנו יוסבו בייסורים לשימושים אחרים".

5. הרצועה של ביג דוג

ברט רוצה שנדאג עכשיו. הוא מודאג לא רק מתוכנות שחמט תמימות, אלא גם מהעובדה שמאמצים גדולים במיוחד מושקעים היום בפיתוח מערכות בינה מלאכותית למטרות ביטחוניות. וכבר עכשיו הוא מזהה שם אותות ראשונים של עצמאות.

כדוגמה ברט נותן את Stuxnet, וירוס התולעת שב־2011 פורסם כי גרם נזק לתוכנית הגרעין האיראנית. כמו אחרים במערב, ברט משוכנע כי מדובר בשיתוף פעולה אמריקאי־ישראלי. "התוכנה הזאת תוקפת מערכות בקרה מסוג SCADA מתוצרת סימנס. היא עשתה את העבודה, אבל ברחה אל העולם הרחב והדביקה הרבה מערכות SCADA אחרות. כעת גם לאויבים פוטנציאליים שלנו יש עותק של סטוקסנט. והרי מערכות הבקרה של סימנס מפעילות גם את רשת האנרגיה בארצות הברית. כפי שמומחה האבטחה הרוסי יבגני קספרסקי אמר, סטוקסנט הפחיתה את העלות של מתקפה על רשת האנרגיה מ־10 מיליון דולר למיליון בלבד, וזה בדיוק מה שמדאיג אותי. האנשים הטובים ביותר שלנו, ב־NSA ואצלכם, במודיעין הישראלי, חושבים שהם יודעים מה טוב. הם מקבלים כוח אדיר ומיד מנצלים אותו לרעה".

“לפי פרסומים בוושינגטון פוסט יש לקהילת המודיעין בארצות הברית תקציב חסוי ענקי של כ-50 מיליארד דולר”, אומר ברט. "אתה חושב שהאנשים שם לא מצליחים לישון בלילה מהחשש שהבינה המלאכותית שהם מפתחים תצא משליטה?”.

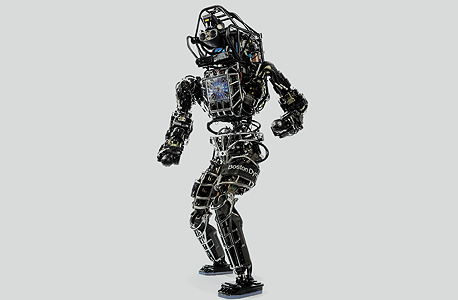

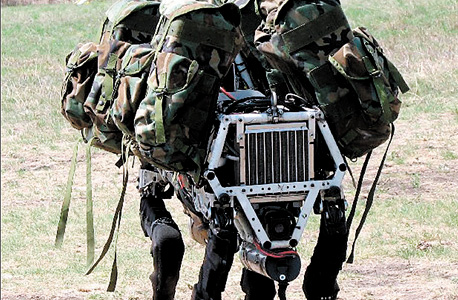

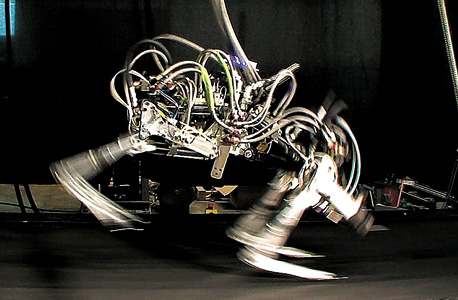

עוד שם ששב ועולה בספר של ברט הוא דארפ"א, רשות פיתוח אמצעי הלוחמה האמריקאית ואחד מגופי המחקר החדשניים ופורצי הדרך בתולדות ארצות הברית. האינטרנט, למשל, החל כמחקר של דארפ"א. כיום היא מממנת עשרות פרויקטים בתחום הבינה המלאכותית והרובוטיקה. את אחד הפרויקטים המתוקשרים יותר שהיא מממנת מפתחת בוסטון דיינמיקס, חברת רובוטיקה פורצת דרך שהקימו יוצאי אוניברסיטת MIT. כל התקדמות בפרויקט הזה הופכת לסרטון ויראלי ביוטיוב: ביג דוג, רובוט משא בעל ארבע רגליים שתנועתו מזכירה גוף חי, אשר מסוגל לטפס על סלעים ומדרונות מושלגים, וגרסה שלו שמצויידת בזרוע מסוגלת להרים חפצים כבדים ולהשליך אותם בעוצמה; אטלס, רובוט דמוי אדם שיודע לטפס במדרגות; והמפחיד מכולם, צי'טה, רובוט הולך על ארבע שמסוגל לרוץ בתנועות חתוליות ובמהירות 60 קמ"ש.

הצפייה בסרטונים של בוסטון דיינמיקס מהפנטת, מפעימה ומטרידה ביותר. "כשאני מסתכל על הרובוטים האלה אני רוצה רובוט כזה לעצמי", מציין ברט וצוחק, "אך אני חושש מהיום שבו אצטרך לרוץ מהר יותר מהרובוט הזה. אנשים אומרים לי, 'אתה עוסק בספקולציות על דברים שיקרו עוד 20, 30 או 100 שנה', אבל כבר היום יש מי שמפתחים מזל"טים שיטוסו ויבחרו מטרות בלי התערבות של מפעיל אנושי מהקרקע. והם מוציאים ניירות מחקר שמספקים צידוקים אתיים לשימוש בכלים האלה, כמו העובדה שמל"טים מדויקים יותר ולכן מוסריים יותר. אותו הדבר יקרה עם רובוטים בשדה הקרב: יש סיכוי לא רע שבעוד עשר שנים היצורים של בוסטון דיינמיקס ירוצו בשטחי קרבות ויירו לכל הכיוונים".

ומה אומרים האנשים שעובדים בתחום?

"כל האנשים שעוסקים בפיתוח בינה מלאכותית מודעים לנושאים האלה, אבל זה לא גורם להם להפסיק לעבוד על הפרויקטים שלהם. להפסיק זה פשוט לא בטבע שלנו".

בספרו ברט מתאר רגע של גילוי דרמטי שאירע לו כאשר עבר על ארכיון כתביו של המתמטיקאי איי ג'יי גוד, מנביאי ענף חקר הבינה המלאכותית. גוד, יהודי שהשתתף במלחמת העולם השנייה בפיצוח קוד האניגמה, מכונת ההצפנה של הצי הגרמני, פרסם ב־1965 את החיבור המכונן "ספקולציות בנוגע למכונה האולטרה־אינטליגנטית הראשונה", שהתווה את הלך הרוח של חוקרי הבינה המלאכותית מאז ועד היום. החיבור נפתח במשפט "הישרדות האדם תלויה בהצלחתו בבניית מכונה אולטרה־אינטליגנטית".

גוד מת בשיבה טובה ב־2009, וכאשר ברט יצא לראיין את עמיתיו ואת חבריו הוא גילה, בסיוע עוזרת המחקר הוותיקה של גוד, מסמך מפתיע שנטמן בארכיון מכון הטכנולוגי של וירג'יניה. ב־1998, כשגוד בן ה־82 קיבל פרס מפעל חיים מאגודת מדעי המחשב האמריקאית, הוא תכנן לסקור את מפעל חייו בקטע קצר שכתב לרגל האירוע, ובו התייחס לעצמו בגוף שלישי ודיבר על "פועלו של גוד". באותו מסמך עלום כתב גוד שהשנים שינו את דעתו, וכתב כך: "'הישרדותו של המין האנושי תלויה בבנייה של מכונה אולטרה־אינטליגנטית'. אלה היו מילותיו של גוד בימי המלחמה הקרה. אבל עכשיו הוא חושב שאת המילה 'הישרדות' יש להחליף ב'הכחדה'".

6. מה אסימוב היה אומר

"המטרה שלי היא להציף את הנושא כשעדיין יש זמן, להתחיל את השיחה", ברט אומר, ומוסיף שהתרעות דומות יצאו באחרונה גם ממכוני מחקר ובהם אוניברסיטת קיימברידג'. "אבל העבודה שלהם היא די אקדמית. אני רוצה להכניס לדיון את הציבור הרחב".

"בשנות השמונים אנשים ידעו על ההתחממות הגלובלית, אבל לא לקחו את זה ברצינות, עד שהגיע אל גור עם הסרט 'אמת מטרידה'", הוא אומר. "אם בשנות השלושים מישהו היה מספר לך על ביקוע גרעיני — הנושא היה האנרגיה האינסופית שנוכל להפיק והבעיות שייפתרו. אלה היו נושאי השיחה זמן קצר לפני שהטכנולוגיה הפכה לנשק ולאקדח שמכוון מאז לראשו של העולם. כאשר מחשבים בעלי בינת־על יהפכו לאיום, זה יהיה שונה מביקוע גרעיני, כי זו תהיה תאונה שלא מסתיימת. ברגע שתיצור אינטליגנציה חכמה יותר מבני אדם, לא תוכל להחזיר את השד לבקבוק, היא לעולם לא תפסיק".

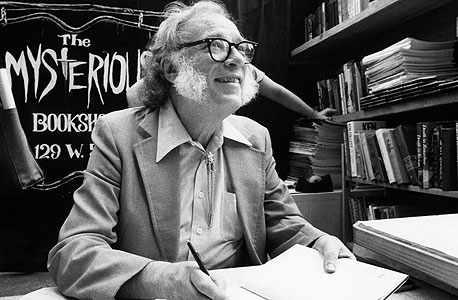

ברט מבקש להציף לא רק את האזהרות, אלא גם לדחוף לדיון רציני יותר בפתרון. "רוב מי שאני מדבר איתו מזכיר את חוקי אסימוב", הוא אומר ומתייחס ל"אני, רובוט", ספרו מ־1950 של סופר המדע הבדיוני אייזיק אסימוב. בספר, שנכתב ב־1950, כאשר מחשבים בעלי יכולות מעטות ומוגבלות תפסו חדרים שלמים, בדה אסימוב טכנולוגיה מורכבת של בינה מלאכותית, שהתבססה על מערכת כללים. פעולתם של רובוטים הוגדרה באמצעות שלושה כללים עיקריים: רובוט לא יפגע באדם ולא יאפשר פגיעה באדם; רובוט ימלא אחר פקודות בני האדם, למעט מקרה של התנגשות עם החוק הראשון; רובוט יגן על קיומו שלו, למעט מקרה של התנגשות עם החוקים הראשון או השני. הסיפורים ב"אני, רובוט" הראו איך מצבים מורכבים גורמים לרובוטים לתקוף בני אדם, לכלוא אותם, לשקר להם ואף לנסות להשתלט על האנושות - והכל בכפוף לשלושת החוקים האלה.

"ואפילו אסימוב הודה שהחוקים האלה היו רק מכשיר יצירתי לכתיבת סיפורים ולא פתרון לבעיה אפשרית", ברט אומר. "ואולם, אנחנו כן צריכים גרסה למבוגרים של חוקי אסימוב, גישה מדעית להתמודדות עם סופר־אינטליגנציה מלאכותית, ואנחנו צריכים את זה לפני שאנחנו חולקים את הכוכב עם אינטליגנציה כזאת".

ובאופן מעשי?

"יש תקדים שאנחנו יכולים ללמוד ממנו: ועידת אסילומר, שהתכנסה ב־1975 בקליפורניה כדי לדון בסכנות האפשריות של ביוטכנולוגיה. כל הממציאים הגדולים בענף התכנסו כדי לקבוע כללי בטיחות יסודיים, כמו התקנה שמחייבת וידוא שלא מוציאים דנ"א ממעבדות, אפילו לא על סוליות הנעליים, כדי שדנ"א מהונדס לא ישתחרר באופן עצמאי אל הטבע. דנ"א שמשתחרר לטבע יכול לגרום אסון. מהוועידה הזאת יצאו כללים טובים, והיום ביוטכנולוגיה תורמת המון לרווחה האנושית. מה שאנחנו צריכים היום הוא ועידת אסילומר לאינטליגנציה מלאכותית. אנחנו צריכים שהיא תתכנס בכל שנה, והרבה לפני שנצליח ליצור בינה מלאכותית ברמה של מוח אנושי. זה לא יהיה קל, כמובן, כי מי שצריכים להשתתף שם הם NSA, דארפ"א, סין, ישראל, גוגל ויבמ - כל מי שנמצאים במסלול המהיר לפיתוח".

יכול להיות שמאוחר מדי?

"אתה לא הראשון ששואל את זה. אני מקווה שלא. מידע הוא הרי הדבר העיקרי שמיוצר על הכוכב הזה כיום. הוא כמו צמח פולש: יש מעבדי מחשב בכל מקום. אני לא חושב שמאוחר מדי, אבל אנחנו מתקרבים לנקודת האל־חזור".

ובכל זאת, תרחיש האימה שלך נשען על הנחה שמחשבים יפתחו מודעות. בכלל לא בטוח שזה יקרה.

"השאלה היא אם אתה מאמין שיש במוח האנושי משהו מיסטי או קסום שאי אפשר להנדס. מנגד, ישנה היפותזת צ'רץ'־טיורינג, שלפיה כל מה שאדם יכול לחשוב, ניתן לחישוב גם במודל ממוחשב. אז אלא אם כן האינטליגנציה האנושית היא קסם, כל מה שאני מדבר עליו יקרה. אני לא חושב שזו תחזית ספקולטיבית. החלק הספקוליטיבי מבחינתי קשור לשאלה הבאה: האם אנחנו הולכים להיות פיקחים מספיק ומהירים מספיק כדי להגיע מוכנים לאתגר הזה".