דו"ח טכנולוגי

פייסבוק מודעת לחוסר האמון בה - וזה לא מעניין אותה

אנשים נמצאים בפייסבוק ממגוון סיבות, אך לא בוטחים ברשת החברתית שתשמור להם על הפרטיות ותחסוך מהם פייק ניוז. החברה, שמודעת היטב לנושא ערכה מחקר מקיף ובפועל בחרה להתעלם מהממצאים תוך חסימה מוחלטת של הפתרונות שהוצעו

אנשים לא בוטחים בפייסבוק. הם נמצאים בה, לעתים מחוסר ברירה, משתמשים בה כי זה המקום הטוב ביותר לשמור על קשר עם מכרים מרוחקים, לגלות תכנים חדשים ולעקוב אחרי רוח הזמן והמקום. אבל הם לא בוטחים בה, לא בוטחים בה שתשמור על הפרטיות שלהם, לא בוטחים בה שתגן עליהם או על המוסדות הדמוקרטיים, לא בוטחים בה שתדע לאזן בין חופש הביטוי להסתה והפצת פייק ניוז, פשוט לא בוטחים בה שתעשה את הדבר הנכון.

מנכ"ל פייסבוק מארק צוקרברג צילום: איי אף פי

מנכ"ל פייסבוק מארק צוקרברג צילום: איי אף פי

ופייסבוק מודעת לזה היטב. כבר ב-2018 היא ידעה את זה. "אנשים לא בוטחים בנו", הכריזה מצגת של החברה מקיץ 2018, חודשים אחרי שפרשת קיימברידג' התפוצצה וכשהחברה היתה בעיצומו של המשבר הגדול בתולדותיה (ממנו עדיין לא התאוששה לחלוטין). באותה תקופה ערכה פייסבוק מחקר נרחב שנועד למצוא פתרונות לאחת הבעיות שנמצאות בשורש חוסר האמון הזה: הנטייה של פייסבוק ליצור מחלוקות בין אנשים ולערער קהילות באמצעות הקצנת השיח וקידום דעות שוליות למרכז הבמה ומתן פלטפורמה לעימותים ארסיים בין משתמשים. לא הבעיה הגדולה ביותר של פייסבוק באותה העת, אבל סוגיה משמעותית בכל זאת.

ואולם, תחקיר נרחב של הוול סטריט ג'ורנל מגלה שלמרות העבודה הנרחבת בנושא בכירי החברה, ובראשם המייסד והמנכ"ל מארק צוקרברג, החליטו בחברה להתעלם ממצאי המחקר ולהחליש או לחסום לחלוטין את הפתרונות שהוצעו. הסיבה? לדברי אנשים בעלי ידע בנושא סמנכ"ל המדיניות של פייסבוק ג'ואל קפלן (שלפי דיווחים אחרים, היה לו חלק מרכזי באי-הפעולה של פייסבוק נגד פייק ניוז בבחירות 2016 בארה"ב), טען נגד מאמצים להפוך את השיחות בפלטפורמה לנעימות יותר באומרו שהם "פטרנליסטיים". חשש אחר היה שהשינויים המוצעים ישפיעו באופן לא יחסי על משתמשים ימנים, דווקא בתקופה שבה החברה מואשמת (שלא בצדק) בהטיה אנטי-ימנית.

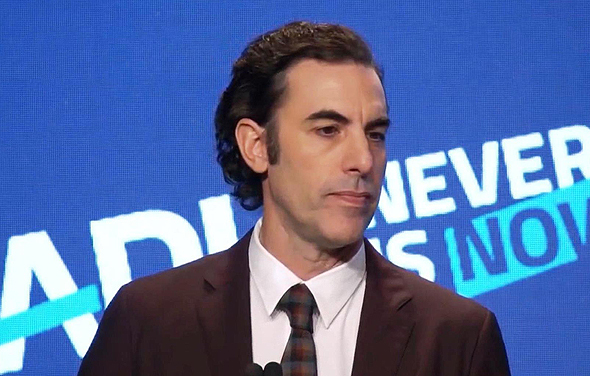

פייסבוק שמעה את נאומו של סשה ברון כהן, ובחרה להתעלם ממנו צילום: youtube

פייסבוק שמעה את נאומו של סשה ברון כהן, ובחרה להתעלם ממנו צילום: youtube

לפי הוול סטריט ג'ורנל, העבודה בנושא התנהלה לאורך מרבית 2017 ו-2018, בהובלת כריס קוקס, אז סמנכ"ל המוצר של החברה ומי שנחשב לסגנו של צוקרברג בכל הנוגע לצד ההנדסי שלה (שעזב מאז את החברה). אחרי שבחנו סוגי אינטראקציות ברשת החברתית, החליטו חברי צוות המחקר שהפתרון צריך להיות מבוסס במחויבות של פייסבוק לנייטרליות, ושהרשת החברתית לא צריכה למשטר דעות או לפעול אקטיבית לעצירת עימותים בפלטפורמה. "אנחנו לא נבנה מוצרים שמנסים לשנות דעות של אנשים. אנחנו מתמקדים במוצרים שמגדילים אמפתיה, הבנה והומניזציה של הצד האחר", נכתב במסמך שהגיע לידי העיתון.

הצעה אחת היתה להגביל שיחות נפיצות בקבוצות באמצעות מתן כלים למנהלי הקבוצה ליצור תת-קבוצה זמנית להכלת הדיו או להגביל את התדירות שבה ניתן לפרסם תגובה בנושא. הצעה אחרת היתה לשנות את אלגוריתם ההמלצות כדי להציג למשתמשים מבחר גדול יותר של קבוצות. לדברי הצוות, אמנם יישום חלק מההצעות יצמצם את היקף הפעילה ברשת החברתית, אבל מדובר במהלך נחוץ ופייסבוק צריכה "לנקוט עמדה מוסרית".

סוגיה אחרת שניסה הצוות לפתור היתה התמודדות עם משתמשים סופר-פעילים. בפייסבוק, למשתמש שמייצר 1,500 יחידות תוכן יש השפעה משמעותית יותר על האלגוריתם מאשר משתמש עם 15 פוסטים בלבד, והוא למעשה יכול להציף על הניוזפיד ולהעלים משתמשים פחות פעילים. בנוסף, משתמשים אלו הם לרוב מפלגתיים וקיצוניים יותר ממשתמשים ממוצעים, והסבירות שיתנהגו בצורה חשודה גדולה יותר. הפתרון המוצע היה להפחית את ההשפעה שלהם על הניוזפיד לטובת משתמשים מתונים יותר.

קפלן ובכירים אחרים התנגדו בטענה שהשינוי יפגע בקבוצות צופות היפותטית. "נניח שילדות הופכות לסופר-פעילות בפייבוק כדי לקדם מכירת עוגיות? השינוי יפגע בהן בצורה לא הוגנת", טען קפלן. הסוגיה הובאה לשולחנו של צוקרברג, שפסק בעד השינוי, אך קצץ את האימפקט שלו ב-80%. באותה הזדמנות אותת המנכ"ל שהוא מאבד עניין במאמצים בתחום וביקש שלא להביא לו עוד סוגיות דומות.

פייסבוק צילום: שאטרסטוק

פייסבוק צילום: שאטרסטוק

גורלן של יוזמות אחרות היה דומה: הן הוחלשו משמעותית, אך לא חוסלו לחלוטין. הפילוג והשיח הרעיל בפלטפורמה, כך נוצר הרושם, פשוט לא היו מספיק חשובים לפייסבוק. בסופו של דבר, הייתה זו דווקא פרשת קיימברידג' אנליטיקה שחיסלה לחלוטין את היוזמה בתחום. בספטמבר 2018, במסגרת הליך ארגון מחדש של צוות הניוזפיד, הודיעו מנהלים שסדר העדיפויות של החברה משתנה, ומתרחק מהמאמצים לשיפור השיח. אם משתמשים רוצים לצפות בתוכן עוין, פייסבוק לא תמנע זאת מהם. הצוות שעסק בתחום פורק.

סגן נשיא פייסבוק, גיא רוזן, שמוביל את צוות הבטיחות והאמינות של החברה, אמר בתגובה שהדיווח מבוסס על מחקר ישן ושלמעשה החברה לא אימצה את הפתרונות השונים מכיוון שבחרה בחלופות יעילות יותר. "שינינו את הדירוג בניוזפיד כדי לתת עדיפות לתוכו מחברים ומשפחה על פני תוכן ציבורי", הוא כתב בטוויטר. "הפחתנו את התפוצה של פוסטים שעושים שימוש בטקטיקות מפלגות ומקטבות כמו קליקבייט והגבלנו את סוג הקבוצות שאנחנו ממליצים עליהן. הגענו להחלטות אלו באמצעות דיון ערני שבו בחנו את כל ההבטים של איך ההחלטה תשפיע על אנשים בחלקים שונים בעולם".

הדברים לא לחלוטין מדויקים. חלק מהמהלכים, כמו שינוי סוג התוכן שמוצג בניוזפיד, נעשו בעיקר כדי לצמצם את ההפצה של פייק ניוז, לא במטרה מפורשת למנוע שיח מקטב ומפלג. ואם גם אתם מתקשים לקבל את הדברים של רוזן כפשוטם, אתם לא לבד. כפי שהבינה פייסבוק עצמה כבר לפני שנתיים, אנשים פשוט לא בוטחים בה. החשיפה הנוכחית מראה שפעם אחר פעם, גם בתקופה שהיא בשיא הביקורת הציבורית, פייסבוק לא ממהרת לנקוט במהלכים שיכולים לפגוע בהיקף הפעילות שבה או להרגיש קבוצות שוליים הזויות אך קולניות. שהחברה פשוט לא מושקעת מספיק בהפיכת הפלטפורמה שלה למקום שאנשים נהנים להיות בו, ולא פשוט מגיעים אליו כי אין להם ברירה טובה יותר. ויום אחד היא אולי עוד תשלם על זה מחיר אמיתי.